Analytics von Streaming-Daten Visual Data Discovery im Sekundentakt

Das Volumen an Streaming-Daten explodiert geradezu. Sie stammen von vernetzten Maschinen, Geräten, Sensoren und aus user-generiertem Content. Jede einzelne dieser Quellen liefert gigantische Mengen hochaktueller Daten.

Anbieter zum Thema

Die Analyse von Streaming-Daten ist nichts grundsätzlich Neues. Sie wird auf den Kapitalmärkten schon seit langem praktiziert. Transaktionen werden hier in Millisekunden abgewickelt. Entsprechend schnell kann sich die Risikostruktur in einem Portfolio ändern.

Heute setzt sich die Nutzung von Streaming-Daten in der Lieferkette, im Kundenservice und im Marketing immer stärker durch. Der Einzelhandel, die Medien, das Gesundheitswesen, die Energiebranche und der Maschinenbau setzen auf Big Data bei der Steuerung von Kommunikation, Prozessen, Produktionsanlagen und in der Wartung. Gartner erwartet, dass 2017 mehr als die Hälfte der Analytics-Implementationen ereignisgesteuerte Datenströme nutzen werden, die von Maschinen, Anwendungen und Personen stammen.

Traditionelle BI-Tools stoßen an Grenzen

Je kurzfristiger Daten zur Verfügung stehen, umso schneller wollen die Anwender diese auch auswerten können. Nach Ansicht von Dr. Wolfgang Martin, einem der führenden europäischen BI-Analysten, können traditionelle BI-Tools wie Berichtserstellungswerkzeuge, Dashboards, Ad-hoc-Anfragen, OLAP - Online Analytical Processing und auch Tabellen keine wirklich neuen Einblicke liefern. Denn sie dienen nur der Zusammenfassung und Diagnose von Daten sowie der Beantwortung bekannter, zuvor festgelegter Fragen.

Die Daten müssen hierzu mithilfe der IT modelliert werden, um semantische Layer und Berichte vorzubereiten, die dann zentral an die Anwender verteilt werden. Diese Werkzeuge sind daher nicht geeignet für dynamische Umgebungen, in denen man fortlaufend neue Fragen stellen und beantworten muss.

Neues entdecken

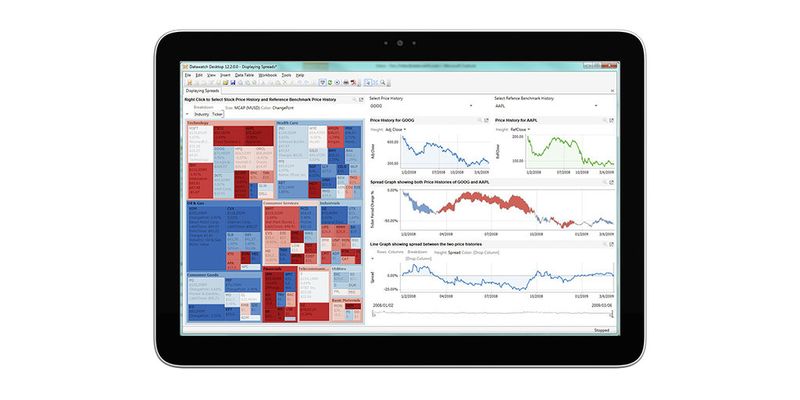

Tools für Visual Data Discovery zeigen dagegen bisher unbekannte Zusammenhänge, Trends, Anomalien und Ausreißer, die Anlass geben für völlig neue Fragestellungen und für eine tiefergehende Untersuchung. Dazu lassen sich verschiedenste Datenquellen verknüpfen. Doch nicht alle Visual-Data-Discovery-Anbieter kommen mit Big Data und mit Streaming-Daten zurecht.

Dabei bietet die Visualisierung von Streaming-Daten einen enormen Vorteil: Man kann bereits bei den ersten Anzeichen eines Problems reagieren. Datenvisualisierung ist ein interaktiver, problembezogener Prozess, der ad hoc intuitive Analysen zulässt.

Visuelle Analysen eignen sich besonders, um große Datenmengen, komplexe Datenstrukturen oder eben Echtzeitdaten zu überwachen und zu analysieren. Denn große Datenmengen und komplexe Datenstrukturen werden durch Visualisierung übersichtlich. Die grafische Darstellung unterstützt das hervorragend ausgeprägte Erkennen von Mustern durch das menschliche Auge.

So lassen sich beispielsweise Ausreißer leicht erkennen und strukturelle Änderungen gleichsam ablesen. Die Daten sollten dazu so wenig wie möglich aggregiert werden – ein weiterer wesentlicher Unterschied zu traditionellen BI-Anwendungen.

(ID:43040871)

:quality(80)/p7i.vogel.de/wcms/f9/e0/f9e0b1c5df2c71dac0ed6c4a6a41daa2/0130504390v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c2/46/c2467c63f76bb87b95a0325250d912bf/0130876149v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/dd/de/ddded0c562bc86a964c72636ce14c0be/0130192405v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e3/95/e39587300e125df30c7917372763139b/0130016264v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2f/b7/2fb7b07cbcbc23a80dcfbe41570c8cf2/0130493230v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a3/72/a3728398797ceec8ea2bca2b17fcd49d/0130470053v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8e/70/8e7083abba5bdaa5b5ab6972670ec5fd/0130190257v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/28/95/289560ddeb2ca55c1e003d57d331063c/0130126830v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/37/af/37af6545336ac8aac53cccaf675c22d5/0116632947v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/34/e734f4d362cad6fc347f5a049b1522db/0129238699v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/35/aa/35aa7935774f380a96e1e3de73c09661/0129631002v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/58/7a/587af12cf063f30f9f1dd8d09a8028ec/0129948269v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e1/53/e1539f6251b6e5502bd1856048c4267e/0128161589v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/16/92/16923d0cc73c198955a4dd2eb6dd0edb/0131090389v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/31/b7/31b7fa6ea6b909935c068de65c126c8f/0131076292v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d3/dc/d3dc300e714e34706f8e70ac540ebcdc/0130561240v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6f/2d/6f2d2fe91fa2a26ab63377f9ee7af674/0130803635v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/94/27/942709ac64ee0b1480a9eca920eed2e3/0130430184v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/1a/81/1a814fa5f0de58d2d61da54aa4b89c6a/0124218373v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/80/31/80314a4d3263db61d8adec623a25c627/0130586130v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/a5/f4a5975b3a19ba3b86896a37c23dac7f/0130771937v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/42/75/4275abee7e37757723bc4b9017d2af88/0131265177v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/99/ba/99ba69a8921df4be68d3e4a900c863cb/0130092667v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d5/59/d5597bab8d5d2a99d6655c93a99ef357/0129935720v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/68/f8/68f8b9869e1288dfa2eeff3a1dc6a7eb/0127838110v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/74/05/74053661b14a2f12ec5e98ebd1469197/0127788138v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c9/1a/c91ad9dfc806cc7df9fe7074ca5e64dd/0127064676v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/43/e4/43e42f37cc71f12e6ae46717e700644e/0126701619v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/82/9a/829ab32db929fbae572a7c8290463a08/0121295821v1.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/67/c6/67c6df851ba69/qunis-profilbild.png)

:fill(fff,0)/p7i.vogel.de/companies/5e/b4/5eb41ddf8e0b6/bdi-insider-logo-2019.png)

:fill(fff,0)/p7i.vogel.de/companies/60/2c/602cdcaa1f5bc/fivetran-logo-blue.png)

:quality(80)/p7i.vogel.de/wcms/eb/bc/ebbcbb417d292f3d20cb3bf87706705c/0125514392v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a3/f3/a3f3542af66038b73ac9f9c8fc3de6b2/0124763168v1.jpeg)