Spark as a Service Das kann Azure Databricks

Microsoft stellt mit Azure Databricks eine Analyseplattform in Microsoft Azure zur Verfügung, die auf der bekannten Analysesoftware Apache Spark aufbaut. Bei der Entwicklung der Plattform haben die Entwickler von Spark mitgearbeitet.

Anbieter zum Thema

Unternehmen, die auf Microsoft Azure setzen und ihre Daten analysieren wollen, haben mit Azure Databricks den Vorteil, auf eine Lösung zu setzen, deren Fundament seit Jahren eine bekannte und zuverlässige Analyseumgebung darstellt. Die Entwickler von Apache Spark haben, zusammen mit Microsoft, Databricks in Azure integriert und die Vorteile von Apache Spark mit den Möglichkeiten der Azure-Cloud verbunden.

Azure Databricks lässt sich mit den Azure-Datenbanken und -Speichern nutzen. Dadurch lassen sich SQL Data Warehouse, Cosmos DB, Data Lake Store und Blob Storage zusammen mit Azure Databricks verwenden. Durch die Integration mit Power BI können Anwender mit Azure Databricks Daten zur Analyse aufbereiten und teilen. Aber auch andere BI-Tools lassen sich einsetzen.

Diese Funktionen von Spark sind in Databricks integriert

Durch die Mitarbeit der Spark-Entwickler an Azure Databricks wurden alle Open-Source-Funktionen integriert, die auch in einem Spark-Cluster verfügbar sind. Dazu gehören Spark SQL und DataFrames für die Verwendung strukturierter Daten in Databricks. DataFrame stellt eine verteilte Sammlung von Daten dar, die in benannten Spalten organisiert sind. Werden in Apache Spark neue Funktionen integriert, implementiert Microsoft diese auch in Azure Databricks.

Auch Echtzeitdatenverarbeitung und -analyse für analytische und interaktive Anwendungen sind integriert. HDFS-, Flume- und Kafka lassen sich einbinden. Die Machine-Learning-Bibliothek MLib mit Lernalgorithmen und Klassifizierung, Regression und Clustering lassen sich ebenfalls nutzen.

GraphX für Diagramme und Diagrammberechnung lassen sich in Databricks ebenfalls verwenden, genauso wie Spark Core-API. Diese bietet die Unterstützung für R, SQL, Python, Scala und Java.

Schnelle Erstellung einer Analyseplattform

Der Vorteil einer Analyseplattform wie Databricks in Microsoft Azure zu nutzen, liegt schnell auf der Hand: Sobald die Umgebung im Einsatz ist, kann sie auf alle anderen Funktionen in Microsoft Azure zugreifen, nicht nur auf die Big-Data-Lösungen. Wurde die Cloud mit einem lokalen Rechenzentrum verbunden, können Daten in der Cloud schnell und einfach analysiert werden. Databricks kann außerdem schnell und leicht skaliert werden. Die Clusterskalierung erfolgt dynamisch.

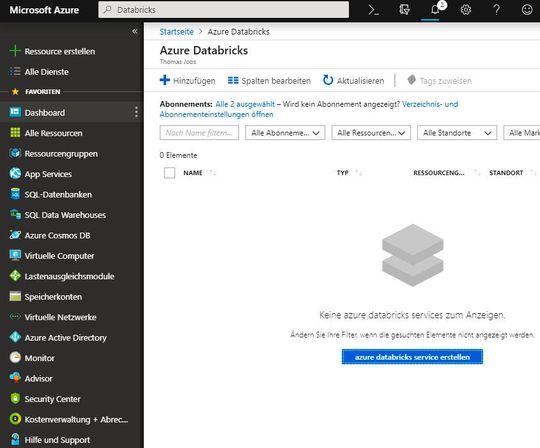

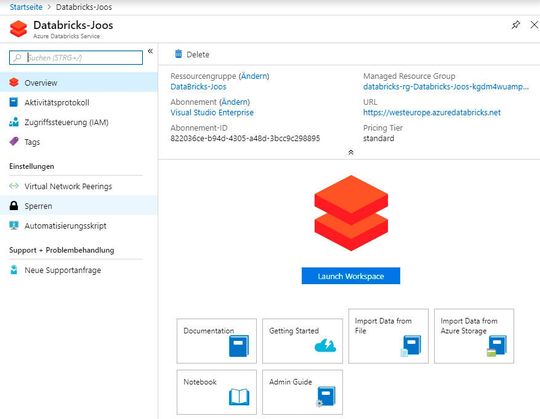

Ein weiterer Vorteil beim Einsatz von Produkten in der Microsoft-Cloud ist die schnelle Einrichtung. Während die Installation und Einrichtung von Apache Spark im Unternehmen einen Cluster und einiges an Know-how erfordert, kann die Azure DataBricks-Umgebung mit einem Mausklick aktiviert werden.

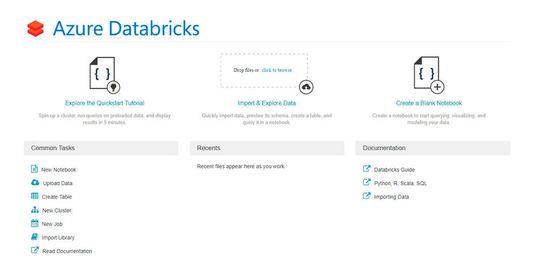

Sobald die Umgebung einmal eingerichtet ist, können Daten importiert und analysiert werden. Daten lassen sich über Dateien und externe Speicher importieren, aber auch aus Azure Storage. Sobald der Workspace gestartet ist, können verschiedene Analysten parallel mit den Daten arbeiten.

Machine Learning mit Azure Databricks

Azure Databricks vereint die meisten der gängigen Big Data Use Cases auf einer einzigen Plattform. Das bedeutet, dass Unternehmen keine verschiedenen Dienste kompliziert miteinander verbinden müssen. Batch-Verarbeitung, echtzeitnahe Stream-Verarbeitung, interaktive Abfragen und Datenanalyse sind in Databricks integriert. Darüber hinaus gibt es viele weitere Möglichkeiten. Auch das maschinelle Lernen und Data Science lassen sich einbinden. Azure Databricks enthält viele maschinelle Lernbibliotheken, unterstützt aber auch die einfache Interaktion mit vielen anderen gängigen maschinellen Lernframeworks wie XGBoost, scikit-learn, TensorFlow, Keras und Horovod.

Azure Databricks bringt durch seine Funktionen Dateningenieure, Datenwissenschaftler und Business-Analysten in einem einzigen kollaborativen Arbeitsbereich zusammen. Dadurch entfällt die Notwendigkeit, mehrere unterschiedliche Tools und Dienste zu verbinden, um verschiedene Benutzer zufriedenzustellen.

Kurze Lernkurve ohne langwierige Schulungen

Azure Databricks ermöglicht die Abfrage, Analyse und Verarbeitung von Daten in SQL, Python, R und Scala. Unternehmen können mit der Integration von Azure Databricks mit einer sehr kurzen Lernkurve den Einstieg in Apache Spark beginnen. In vielen Fällen können bestehende Teams ihre aktuellen Fähigkeiten und Kenntnisse direkt in Azure Databricks übertragen, wobei teure Neueinstellungen oder umfangreiche Schulungen nicht mehr notwendig sind.

ETL-Entwickler und Business-Analysten, die SQL bereits in ihrer täglichen Arbeit einsetzen, können recht schnell mit Databricks arbeiten. Datenwissenschaftler, die bereits R oder Python einsetzen, sind ebenfalls sofort in der Lage, effektiv mit Azure Databricks zu arbeiten. Auch Anwendungsentwickler, die mit Python oder Java vertraut sind, können Databricks schnell nutzen.

Die Verwaltung von Azure Databricks ist sehr einfach. Sobald der Dienst aktiviert wird, ist er mit dem Azure Active Directory verbunden. Von dort aus ist das Hinzufügen von Benutzern, das Erstellen von Clustern und das Verwalten des Arbeitsbereichs intuitiv und kann über eine sehr einfache Benutzeroberfläche erfolgen. Fast alles, was ein Unternehmen typischerweise konfigurieren müsste, kann über diese Benutzeroberfläche erfolgen. Mit der REST-API und der CLI, die für eine erweiterte Konfiguration und Automatisierung verwendet werden können, lassen sich auch spezifische Umgebungen aufbauen.

(ID:45714291)

:quality(80)/p7i.vogel.de/wcms/9d/a9/9da9b4fd060f62036a63dc5ea316f4ef/0131283932v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/5b/db/5bdb1266805002fc22dfc91f8464323d/0130876458v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f9/e0/f9e0b1c5df2c71dac0ed6c4a6a41daa2/0130504390v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c2/46/c2467c63f76bb87b95a0325250d912bf/0130876149v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2f/b7/2fb7b07cbcbc23a80dcfbe41570c8cf2/0130493230v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a3/72/a3728398797ceec8ea2bca2b17fcd49d/0130470053v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8e/70/8e7083abba5bdaa5b5ab6972670ec5fd/0130190257v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/28/95/289560ddeb2ca55c1e003d57d331063c/0130126830v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/37/af/37af6545336ac8aac53cccaf675c22d5/0116632947v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/34/e734f4d362cad6fc347f5a049b1522db/0129238699v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/35/aa/35aa7935774f380a96e1e3de73c09661/0129631002v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/58/7a/587af12cf063f30f9f1dd8d09a8028ec/0129948269v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e1/53/e1539f6251b6e5502bd1856048c4267e/0128161589v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/80/c7/80c789bb8e9a6474040bcc1dfd2934af/0131283865v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/16/92/16923d0cc73c198955a4dd2eb6dd0edb/0131090389v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/31/b7/31b7fa6ea6b909935c068de65c126c8f/0131076292v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d3/dc/d3dc300e714e34706f8e70ac540ebcdc/0130561240v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/94/27/942709ac64ee0b1480a9eca920eed2e3/0130430184v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/1a/81/1a814fa5f0de58d2d61da54aa4b89c6a/0124218373v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/80/31/80314a4d3263db61d8adec623a25c627/0130586130v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/a5/f4a5975b3a19ba3b86896a37c23dac7f/0130771937v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b4/a6/b4a6fe8ae855be632fa09a1a9c96ce16/0131275751v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/49/7f/497f4d8787bf22293929e13557e61113/0131151717v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/99/ba/99ba69a8921df4be68d3e4a900c863cb/0130092667v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d5/59/d5597bab8d5d2a99d6655c93a99ef357/0129935720v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/68/f8/68f8b9869e1288dfa2eeff3a1dc6a7eb/0127838110v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/74/05/74053661b14a2f12ec5e98ebd1469197/0127788138v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c9/1a/c91ad9dfc806cc7df9fe7074ca5e64dd/0127064676v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/43/e4/43e42f37cc71f12e6ae46717e700644e/0126701619v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/82/9a/829ab32db929fbae572a7c8290463a08/0121295821v1.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/61/8e/618e774811e12/logo-disy-mit-slogan.png)

:fill(fff,0)/p7i.vogel.de/companies/67/c6/67c6df851ba69/qunis-profilbild.png)

:fill(fff,0)/p7i.vogel.de/companies/60/2c/602cdcaa1f5bc/fivetran-logo-blue.png)

:quality(80)/p7i.vogel.de/wcms/7f/fb/7ffb6b273b3f67241d2e365e221d1ca4/0127694438v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/73/f8/73f823d4efa52d189464ba7f14e67353/0128362051v1.jpeg)