Grundlagen Statistik & Algorithmen, Teil 3 Speed für Mustererkennung mit dem Rete-Algorithmus

Geschäftsregeln halten zahlreiche Unternehmensprozesse am Laufen, deshalb können sie mitunter sehr umfangreich werden. Der Umfang macht ihre Ausführung zeitaufwendig, weshalb jede Methode, sie zu beschleunigen, willkommen ist. Der Rete-Algorithmus beschleunigte 1979 die damals bestehenden Systeme für die Verarbeitung von Business Rules um den Faktor 3.000. Er ist bis heute die Grundlage zahlreicher Expertensysteme, etwa in der Mustererkennung.

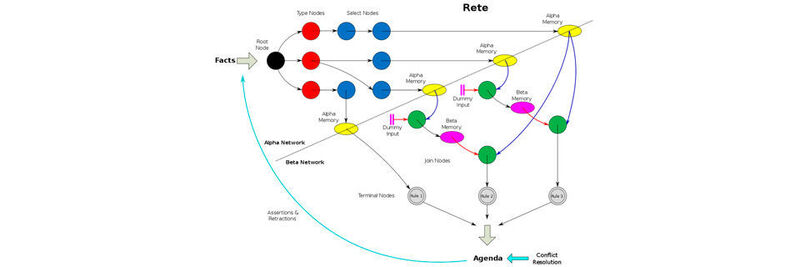

Der Rete-Algorithmus (lateinisch rete „Netz“, „Netzwerk“) ist ein Algorithmus und Expertensystem zur Mustererkennung und zur Abbildung von Systemprozessen über Regeln. Ist eine bestimmte Menge von Bedingungen erfüllt, wird eine oder mehr Regeln ausgeführt. Aber es gibt natürlich Konflikte.

Der ganze Ablauf wird von einem Interpreter orchestriert, der die Nutzung von zwei Speicherbereichen steuert. Im ersten Speicherbereich, dem Production Memory, befindet sich eine Reihe von Regeln, die als „productions“ bezeichnet werden. Im Data Memory hingegen befindet sich eine Reihe von Fakten in einer Datenbank.

Zuerst schaut ein Mustervergleicher des Interpreters in beiden Speicherbereichen nach, welche Fakten zu den Bedingungen der Regeln passen, um sie zu erfüllen. Der Vergleicher erstellt eine Liste von erfüllten Regelbedingungen, schickt sie an den Konfliktlöser, der mithilfe eines Algorithmus untersucht, welche Regel am besten für die Lösung der Aufgabe geeignet ist.

Ist der Konflikt bereinigt, wird die ausgewählte Regel angestoßen und im geeigneten System (Arbeitsspeicher) ausgeführt. Die Regel führt Änderungen herbei, entweder im Production Memory oder im Data Memory. Dann beginnt der Zyklus von vorne. Das Zuweisen von Regeln zu Daten wird „Inferenz“ genannt, ein Vorgang, der in der Mustererkennung mittels Deep Learning heute (wieder) sehr aktuell ist. Die Inferenz muss beispielsweise beim Autonomen Fahren extrem schnell ablaufen, damit das Verhalten des KI-gestützten Systems keine Schäden verursacht.

Der Rete-Algorithmus vergleicht die Fakten und zieht Schlussfolgerungen. Liegen Fakt X und Bedingung Y im Data Memory vor, dann sollte vom Konfliktlöser eine bestimmte Regel aus dem Production Memory ausgewählt werden. Das Vergleichen im Konfliktlöser kann angesichts vieler Daten und Tausenden von möglichen Regeln sehr lange dauern.

Beispiel

Ein Detektiv kann als ein menschliches Expertensystem angesehen werden, denn er oder sie ist ein Experte für Fakten, Bedingungen und Vergleiche.

- 1. Wenn eine Person X etwas Illegales getan hat, so ist X ein Verbrecher.

- 2. Befinden sich Fingerabdrücke von X auf einem Gegenstand Y, denn hat X Objekt Y zu einem vergangenen Zeitpunkt berührt.

- 3. Falls Person X Person Y erschossen hat, dann hat Person X etwas Illegales getan.

- 4. Falls Person X (oder auch Y) tot ist, dann sollte Person X nicht zum Abendessen eingeladen werden.

- 5. Person X heißt Fred.

- 6. Person Y heißt Sam und ist tot.

- 7. Fred erschoss Sam und sollte nicht zum Abendessen eingeladen werden.

Die Konfliktmenge enthält wie oben formuliert zwei Regeln. Der Rete-Algorithmus führt sie zusammen und löst den Konflikt. Vor der Formulierung des Rete-Algorithmus prüften Systeme jede einzelne Regel daraufhin, ob sie zu den Fakten passte – in Iterationen. Durch das Indizieren der Daten und der Regelelemente in einem Index konnte der Prozess des Mustervergleichs zwar beschleunigt werden, aber erst Rete eliminiert die Iteration. Er speichert die Elemente der Konfliktmenge im Arbeitsspeicher und addiert oder löscht sie dort, je nachdem welche Datenelemente addiert oder gelöscht werden. Eine iterative Wiederholung wird überflüssig.

:quality(80)/images.vogel.de/vogelonline/bdb/1396700/1396763/original.jpg)

Grundlagen Statistik & Algorithmen, Teil 1

Das Problem des Handlungsreisenden und seine praktischen Anwendungen

Wenn beispielsweise die Regel auftaucht: „Wenn jemand eine Waffe auf mich abfeuert, ducke ich mich“, dann müssen mehrere Daten gegeben sein: Eine Waffe ist gefährlich und jemand feuert eine auf mich ab usw. Daher ist es klug und lebenserhaltend, der Kugel durch Ducken aus dem Wege zu gehen. Unter anderen Fakten und Bedingungen – etwa Geschosse, die ein automatisches Zielsuchsystem besitzen – sind andere Regeln für das Verhalten sinnvoller. Immer wenn sich etwas in dieser Konfliktmenge ändert, wird das zugehörige Muster (die Regel) geändert und alle vorherigen Muster gelöscht. Der Vorteil: Der Algorithmus muss nie im Data Memory nachschauen – und auch nicht alle potentiellen Regeln abklappern. Denn es gibt eine zweite Rete-Hälfte, die das obsolet macht.

Rete speichert die Bedingungen aller „production“-Regeln in einem Sortier-Netzwerk, das wie ein Baum aufgebaut ist. Der Algorithmus kompiliert das Netzwerk aus der Liste dieser Regeln und hält anschließend das Netzwerk auf dem laufenden, sobald Regeln zur Liste addiert oder daraus gelöscht werden.

Um zu verstehen, wie das funktioniert, schaut man sich ein paar Regeln im Expertensystem eines Süßwarenherstellers an. Zwei Production-Regeln in diesem System lauten:

- 1. Regel für ROTE__RUNDE__STÜCKE: Der Zweck besteht darin, ein. Süßwarenstück zu bestimmen. Ist das Süßwarenmuster rot und außerdem noch rund, stellt man die Hypothese auf, es sei ein runder roter Lutscher.

- 2. Regel für ROTE_ZYLINDRISCHE_STÜCKE: Gleichermaßen stellt man für ein rotes, zylindrisches Muster die Hypothese auf, es handle sich um eine Zuckerstange.

Das baumförmige Sortiernetzwerk des Algorithmus nutzt diese Redundanzen aus. Der Mustervergleicher kompiliert ein Netzwerk aus einzelnen Unterbedingungen. Er schaut jedes einzelne Element einer Regeln an und erstellt daraus eine Kette aus Gliedern, deren Attribut sich einzeln prüfen lässt. Dann schaut sich der Algorithmus Vergleiche zwischen Elementen an (er vergleicht beispielsweise die OBJEKT-Variable des ZIELs mit der NAME-Variable [„Lutscher“ etc.] des SÜSSWARENMUSTERs) und verknüpft Ketten mit neuen Gliedern. Abschließend werden Endglieder hinzugefügt, um anzuzeigen, dass alle Bedingungen für die Regel erfüllt worden sind. In einem Artikel im „Dr. Dobbs Magazine“ wird die Funktionsweise für ein OPS genauer erklärt.

Heutiger Einsatz

RETE bildet heutzutage die Grundlage für viele Regelsysteme wie etwa diverse Prolog-Interpreter oder sogenannte Business Rules Engines und hat sich für diese als De-facto-Standard etabliert. Heute wird Rete überall gelehrt, implementiert (etwa im SAP Business Rules Management und sogar im Roboter-Fußball verwendet.

:quality(80)/images.vogel.de/vogelonline/bdb/1404000/1404092/original.jpg)

Grundlagen Statistik & Algorithmen, Teil 2

So verfeinert das Bayes-Theorem Spam-Filter – und mehr

Rete I war kostenlos, da das US-Verteidigungsministerium seine Entwicklung mit Steuergeldern finanzierte. Bislang gibt es zwei direkte Nachkömmlinge, nämlich Rete II und Rete III, die allerdings kostenpflichtig sind. Beide sind ungefähr 50-mal schneller als der ursprüngliche Ansatz. Rete III umfasst ein paar Erweiterungen, die seine Effizienz nochmals leicht erhöhen.

Er wurde vom US-amerikanischen Informatiker Charles Forgy im Rahmen seiner Doktorarbeit an der Carnegie Mellon University entwickelt, der ihn 1979 zum Titel führen sollte. Die Entwicklung war 1979 eng an die Plattform DEC XCON (DEC: Digital Equipment Corp.) angelehnt und fand ihre Implementierung zunächst in Betriebsunterstützungssystemen, speziell in OPS2 bzw. später in OPS5. Einsparungen in Millionenhöhe wurden benannt. Das implementierte Regelwerk hatte im Endausbau an die 10.000 Elemente.

Im Jahr 2010 entwickelte Forgy eine neue Generation des Rete-Algorithmus und nannte sie einfach Rete NT. In einem Benchmark-Test der Zeitschrift „InfoWorld“ wurde NT als 500-mal schneller als der ursprüngliche Algorithmus und zehnmal schneller als sein Vorgänger Rete II gemessen. NT ist jetzt an die Firma SparklingLogic lizenziert, in die Charles Forgy eintrat, und zwar als Inferenzmaschine des SMARTS-Produkts.

:quality(80)/images.vogel.de/vogelonline/bdb/1430600/1430659/original.jpg)

Grundlagen Statistik & Algorithmen, Teil 4

Der Monte-Carlo-Algorithmus und -Simulationen

Das verbreitete Werkzeug Drools, das zusammen mit der Firma Jboss von IBM aufgekauft wurde, ist ein Beispiel für eine Business-Rule-Engine, die auf dem Rete-Algorithmus basierte. Seit Version 6.0 ist in Drools ein Nachfolge-Algorithmus namens PHREAK aktiv.

Als einziger Nachteil lässt sich nennen, dass die hohe Geschwindigkeit des Algorithmus zu Lasten des genutzten Speichers geht, doch das dürfte angesichts des heute zu Tiefpreisen verfügbaren Speichers kein Problem mehr sein. Und dass man seine Algorithmen stets möglichst effizient schreiben sollte, bedarf keiner gesonderten Erwähnung.

:quality(80)/images.vogel.de/vogelonline/bdb/1481900/1481934/original.jpg)

Grundlagen Statistik & Algorithmen, Teil 5

Optimale Clusteranalyse und Segmentierung mit dem k-Means-Algorithmus

:quality(80)/images.vogel.de/vogelonline/bdb/1509200/1509209/original.jpg)

Grundlagen Statistik & Algorithmen, Teil 6

Die Ereigniszeitanalyse – wenn Anfang und Ende die Erfolgsrate bestimmen

:quality(80)/images.vogel.de/vogelonline/bdb/1524900/1524972/original.jpg)

Grundlagen Statistik & Algorithmen, Teil 7

So deckt der Local Outlier Factor Anomalien auf

(ID:45349547)

:quality(80)/p7i.vogel.de/wcms/dd/de/ddded0c562bc86a964c72636ce14c0be/0130192405v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e3/95/e39587300e125df30c7917372763139b/0130016264v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/87/b8/87b89fb6ef45cbd96a394a466cd67f23/0130816397v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/59/0b/590bdb8dd7816097e1c233b138c3cf92/0130720216v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2f/b7/2fb7b07cbcbc23a80dcfbe41570c8cf2/0130493230v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a3/72/a3728398797ceec8ea2bca2b17fcd49d/0130470053v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8e/70/8e7083abba5bdaa5b5ab6972670ec5fd/0130190257v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/28/95/289560ddeb2ca55c1e003d57d331063c/0130126830v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/37/af/37af6545336ac8aac53cccaf675c22d5/0116632947v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/34/e734f4d362cad6fc347f5a049b1522db/0129238699v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/35/aa/35aa7935774f380a96e1e3de73c09661/0129631002v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/58/7a/587af12cf063f30f9f1dd8d09a8028ec/0129948269v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e1/53/e1539f6251b6e5502bd1856048c4267e/0128161589v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/d3/dc/d3dc300e714e34706f8e70ac540ebcdc/0130561240v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6f/2d/6f2d2fe91fa2a26ab63377f9ee7af674/0130803635v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b7/0a/b70a5c1423936cec92894bbc0e4b5420/0130683263v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/62/22/6222736cd26d88f18075cdd971cd1541/0129698372v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/1a/81/1a814fa5f0de58d2d61da54aa4b89c6a/0124218373v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/80/31/80314a4d3263db61d8adec623a25c627/0130586130v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/a5/f4a5975b3a19ba3b86896a37c23dac7f/0130771937v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/75/da/75daff3c7113e9bfd5c842c2455e3ead/0130146226v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/1b/3f/1b3f46d2b8086fc51fa997bc1b122854/0131019988v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6d/8a/6d8ad333190915c0d3f19a5463ffab19/0130252150v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/99/ba/99ba69a8921df4be68d3e4a900c863cb/0130092667v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d5/59/d5597bab8d5d2a99d6655c93a99ef357/0129935720v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/68/f8/68f8b9869e1288dfa2eeff3a1dc6a7eb/0127838110v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/74/05/74053661b14a2f12ec5e98ebd1469197/0127788138v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c9/1a/c91ad9dfc806cc7df9fe7074ca5e64dd/0127064676v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/43/e4/43e42f37cc71f12e6ae46717e700644e/0126701619v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/82/9a/829ab32db929fbae572a7c8290463a08/0121295821v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/90/c3/90c302b9470136bdcf725549552fe6b1/0129302897v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/28/95/289560ddeb2ca55c1e003d57d331063c/0130126830v1.jpeg)