Grundlagen Statistik & Algorithmen, Teil 14 Mit Diskriminanzanalyse die Spreu vom Weizen trennen

Gibt es mehr als zwei Klassen, die zu klassifizieren sind, ziehen Experten den Algorithmus der Diskriminanzanalyse der linearen Regression vor. Die Diskriminanz- oder Unterscheidungsfunktion sorgt dafür, dass zwei Klassen, die sich möglicherweise in einer Schnittmenge überlappen, schärfer getrennt werden, beispielsweise Käufer von Nicht-Käufern.

Anbieter zum Thema

Die Diskriminanzanalyse (DA) enthält statistische Merkmale (Variablen) der Daten, die für jede Klasse berechnet werden. Dabei kann sie Gruppen auf signifikante Unterscheidungen ihrer Merkmale prüfen und dafür geeignete oder ungeeignete Merkmale benennen. Für eine einzelne Eingabevariable schließt dies folgendes ein: Berechnet werden der Mittelwert für jede Klasse und die Varianz, die für alle Klassen berechnet wird.

Zudem sagt diese Methode voraus, welche die Klasse mit dem höchsten Wert sein wird. So lässt sich etwa ermitteln, welche Personen gute und schlechte Kreditnehmer oder Käufer und Nicht-Käufer sind. Nicht nur in der Statistik, sondern auch im Machine Learning lässt sich die Diskriminanzanalyse nutzen, um durch Raumtransformation eine gute Darstellung von Merkmalen zu erreichen. Sie dient als Klassifikator oder zur Reduktion von Dimensionen.

Eine Bank kann beispielsweise Kreditinteressenten in „kreditwürdig“ und „nicht kreditwürdig“ einteilen. Wenn ein Bankkunde einen Kredit beantragt, versucht das Institut, anhand von Merkmalen wie Höhe des Einkommens, Zahl der Kreditkarten, Beschäftigungsdauer bei der letzten Arbeitsstelle usw. auf die zukünftige Zahlungsfähigkeit und -willigkeit des Kunden zu schließen. Allerdings besteht die Gefahr von „false positives“, also einer Grauzone oder Schnittmenge, in denen irrtümlicherweise ein schlechtes Engagement als gut, andererseits ein gutes Kreditengagement als schlecht klassifiziert werden kann. Die Diskriminanzanalyse sorgt dafür, dass diese Schnittmenge verschwindet und eine klare Trennung der beiden Klassen erfolgt.

Zweites Beispiel: Kunden einer Supermarktkette lassen sich als Markenkäufer und Noname-Käufer klassifizieren. Die ersteren haben offenbar ein höheres Budget, das es zu nutzen gilt. In Frage kommende Merkmale (Variablen) wären etwa die jährlichen Gesamtausgaben in diesen Läden, der Anteil von Markenprodukten an den Ausgaben usw.

In jedem dieser Beispiele ist ein metrisch skaliertes Merkmal X zu beobachten, sei es Kreditwürdigkeit (Bonität) oder Markenkäufer (Budget). Dieses Merkmal wird im Modell der Diskriminanzanalyse als eine Zufallsvariable X behandelt. Wie man an den Beispielen ablesen kann, gibt es mindestens zwei Populationen oder Grundgesamtheiten. Aus einer der beiden stammt das gesuchte Objekt.

Durch Klassifikation mithilfe der Diskriminanzfunktion lässt sich das Objekt einer der beiden Klassen regelmäßig zuordnen. Eine Diskriminanzfunktion oder Trennfunktion ist eine Funktion, die bei der Diskriminanzanalyse jeder Beobachtung einen Scorewert zuordnet. Aus dem Scorewert wird die Gruppenzugehörigkeit jeder Beobachtung und die Grenzen zwischen den Gruppen bestimmt. Bei bekannter Gruppenzugehörigkeit der Beobachtungen werden also die Merkmalsvariablen bei minimalen Informationsverlust zu einer einzigen Diskriminanzvariablen zusammengefasst.

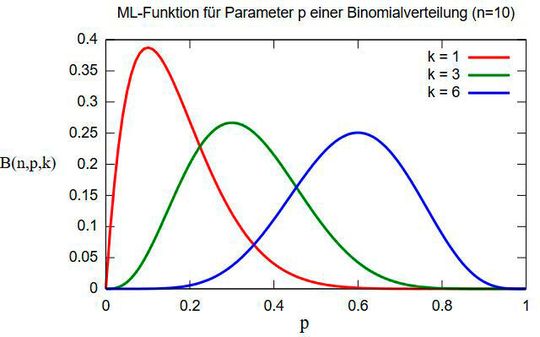

Maximum-Likelihood-Methode

Eine Methode der Zuordnung ist die Maximum-Likelihood-Methode: Man ordnet das Objekt der Gruppe zu, deren Likelihood (Wahrscheinlichkeit) am größten ist. Die Maximum-Likelihood-Methode, kurz ML-Methode, auch Maximum-Likelihood-Schätzung (maximum likelihood: englisch für größte Plausibilität, daher auch Methode der größten Plausibilität), Methode der maximalen Mutmaßlichkeit, Größte-Dichte-Methode oder Methode der größten Dichte bezeichnet in der Statistik ein parametrisches Schätzverfahren. Dabei wird – vereinfacht ausgedrückt – derjenige Parameter als Schätzung ausgewählt, gemäß dessen Verteilung die Realisierung der beobachteten Daten am plausibelsten erscheint.

Im folgenden Beispiel liegen ein Merkmal, aber zwei Gruppen und gleiche Varianzen (Abweichungen) vor. Große Varianzen sorgen für mehr Klarheit, denn dann ist die Schnittmenge bzw. Überlappung am geringsten.

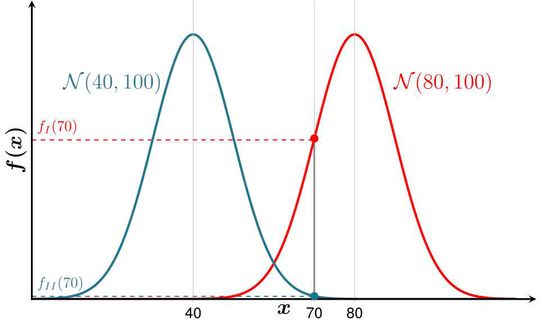

Eine Gärtnerei hat die Möglichkeit, eine größere Menge Samen einer bestimmten Sorte Sonnenblumen günstig zu erwerben. Um den Verdacht auszuräumen, dass es sich dabei um alte, überlagerte Samen handelt, wird eine Keimprobe gemacht. Man sät also 1 g Samen aus und zählt, wie viele dieser Samen keimen. Aus Erfahrung ist bekannt, dass die Zahl der keimenden Samen pro 1 g Saatgut annähernd normalverteilt ist. Bei frischem Saatgut (Population I) keimen im Durchschnitt 80 Samen, bei altem (Population II) sind es nur 40 Samen.

- Population I: Die Zahl der frischen Samen, die keimen, ist verteilt als X I ∼ N ( 80 ; 10 hoch 2 )

- Population II: Die Zahl der alten Samen, die keimen, ist verteilt als X II ∼ N ( 40 ; 10 hoch 2 )

Die Keimprobe hat nun x=70 ergeben. Eine Grafik zeigt, dass bei dieser Probe die Likelihood der Population I am größten ist. Man ordnet also diese Keimprobe als frisch ein.

Auch Vorhersagen werden mit der Diskriminanzanalyse erstellt, und zwar indem ein Diskriminanzwert für jede Klasse berechnet und eine Vorhersage für die Klasse mit dem höchsten Wert gemacht wird. Die Diskriminanzanalyse eignet sich also am besten für die Klassifikation von prädiktiven Modellierungsproblemen.

:quality(80)/images.vogel.de/vogelonline/bdb/1743300/1743342/original.jpg)

Grundlagen Statistik & Algorithmen, Teil 13

Das Akaike Information Criterion

:quality(80)/images.vogel.de/vogelonline/bdb/1726100/1726107/original.jpg)

Grundlagen Statistik & Algorithmen, Teil 12

Der Random-Forest-Klassikator als Entscheidungshilfe

:quality(80)/images.vogel.de/vogelonline/bdb/1700700/1700745/original.jpg)

Grundlagen Statistik & Algorithmen, Teil 11

Methoden der Linearen Regressionsanalyse

:quality(80)/images.vogel.de/vogelonline/bdb/1676700/1676758/original.jpg)

Grundlagen Statistik & Algorithmen, Teil 10

Mit einfacher Regressionsanalyse Mittelwerte in Prognosen ermitteln

:quality(80)/images.vogel.de/vogelonline/bdb/1583700/1583738/original.jpg)

Grundlagen Statistik & Algorithmen, Teil 9

Der Greedy-Algorithmus

:quality(80)/images.vogel.de/vogelonline/bdb/1568300/1568371/original.jpg)

Grundlagen Statistik & Algorithmen, Teil 8

Der Approximationsalgorithmus

(ID:47240504)

:quality(80)/p7i.vogel.de/wcms/9b/ef/9bef0a77a5695439866debdaba18ba16/0130054146v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/39/9a/399a23ac13512099ac0a298e926c3a71/0123336583v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c4/99/c4999d632d9f7aa4cf916f948975792c/0129899268v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/55/00/550007979508377a91017d5d9625a7e5/0129898368v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/a3/72/a3728398797ceec8ea2bca2b17fcd49d/0130470053v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8e/70/8e7083abba5bdaa5b5ab6972670ec5fd/0130190257v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/28/95/289560ddeb2ca55c1e003d57d331063c/0130126830v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/0c/d8/0cd89e354ae9a39e4cc21bdf8e84d617/0130136165v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/37/af/37af6545336ac8aac53cccaf675c22d5/0116632947v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/34/e734f4d362cad6fc347f5a049b1522db/0129238699v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e1/53/e1539f6251b6e5502bd1856048c4267e/0128161589v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/c9/1a/c91ad9dfc806cc7df9fe7074ca5e64dd/0127064676v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/43/e4/43e42f37cc71f12e6ae46717e700644e/0126701619v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/44/a4/44a46c9ceab98af6ff329088a54cab08/0130095999v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/fe/a8/fea8f6059c37426fdf63e7554e9f9f4b/0130316817v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a3/0c/a30c93256bbda6759aabfcebbfcacb77/0129964017v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d3/a3/d3a31ea4e0bc62c49bf42099f907b6c6/0129912380v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/fb/c7/fbc717c4ca741003b01549908e6831bb/0129747508v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/1d/a5/1da5ee3d7b323edcdf5aab97e8e1b6b5/0130407684v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/91/19/9119fa96f1e5da8b20b482def7cfc803/0130368473v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d4/32/d43236754073cadc6da1d131be06493b/0130357245v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/26/a3/26a3811e39c6d5f69ccbe747d2eaa76f/0130496606v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/99/ba/99ba69a8921df4be68d3e4a900c863cb/0130092667v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d5/59/d5597bab8d5d2a99d6655c93a99ef357/0129935720v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/68/f8/68f8b9869e1288dfa2eeff3a1dc6a7eb/0127838110v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/74/05/74053661b14a2f12ec5e98ebd1469197/0127788138v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/82/9a/829ab32db929fbae572a7c8290463a08/0121295821v1.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/68/2d/682dd583dcc4c/fsas-afc-horizontal-2-positive-rgb-nov24.png)

:fill(fff,0)/p7i.vogel.de/companies/64/59/6459ff78aba1f/infomotion-logo-bild-text-rgb.jpeg)

:quality(80)/p7i.vogel.de/wcms/ee/a4/eea4a5a6a65b74416b6aadbc541793b6/0124853049v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/7b/91/7b91805adb97e49363f104f5b18cad75/0126737348v1.jpeg)