Tutorial von Philipp Lenz, Adesso Datenmodellierung und Präsentation mit Power BI

Die Power-BI-Plattform ist nun seit mehr als einem Jahr auf dem Markt und bietet die Möglichkeit, Daten in einem Datenmodell zu orchestrieren und in beeindruckenden Dashboards zu visualisieren. Die Herkunft der Daten ist dabei nicht nur auf Datenquellen von Microsoft beschränkt, sondern erstreckt sich auch auf viele andere wie beispielsweise Oracle, OData, Flatfiles etc.

Anbieter zum Thema

So schön und einfach der Aufbau eines Datenmodells in vielen Demonstrationen aussieht, so schnell ist es in der Praxis auch umgesetzt. Aber die Komplexität im Modell steigt durch stetig wachsende Anforderungen und die Datenmenge. Die Praxis strapaziert somit das Datenmodell und auch dessen Wartbarkeit. Der folgende Artikel zeigt Best-Practice-Lösungsansätze für optimale Datenmodelle auf und erläutert Möglichkeiten individueller Visualisierungsformen, um optimale Darstellungen zu zaubern. Der Artikel zeigt zudem, wie Informationen in Organisationen verteilt sind und wie sich bestehende SQL-Server-Berichte in Microsoft Power BI einbinden lassen.

Datenmodelle von Anfang bis Ende richtig planen und sie auf die Quellen abstimmen

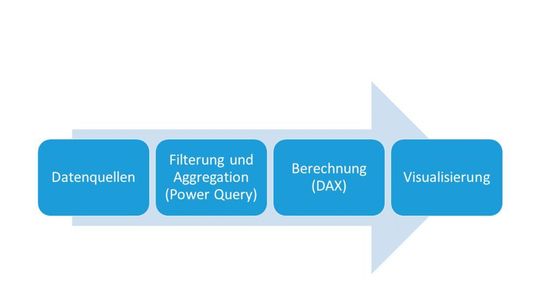

Wie in Abbildung 1 zu sehen ist, werden verschiedenste Daten in ein Datenmodell durch die Vielzahl an Verbindungsmanagern in ein Power-BI-Modell importiert. Diese Datenquellen haben in der Regel unterschiedlichste Aktualisierungs-Rhythmen und Granularitäten. Dies ist eine der Herausforderungen für die ETL-Prozesse und den Datenimport, um die Daten im Datenmodell auf ein gemeinsames fachliches Level zu heben. Hier empfiehlt es sich, eine „High Level Map“ als Dokumentation mit den Aktualisierungsintervallen zu erstellen und bei Bedarf nur einzelne Datenquellen zu aktualisieren, um die Daten nach Aktualität zu organisieren. Lässt sich hier dauerhaft kein gemeinsamer Nenner finden (weil zum Beispiel manche Datenquellen sich schneller und andere sich langsamer oder unzuverlässiger aktualisieren), ist es sinnvoll, eine ETL-Strecke in ein Data-Warehouse zu implementieren mit dem Ziel, eine Analyseschicht für Auswertungen bereitzustellen.

Daten-Importe richtig umsetzen

Ist diese Hürde genommen, lässt sich mit dem Importieren und dem Erstellen eine Microsoft-Power-BI-Mappe starten. Für den Import in Power BI lassen sich einerseits die Daten direkt in das Datenmodell importieren oder via Power Query, beziehungsweise mit der Programmiersprache „M“ transformiert in das Datenmodell einfügen, und zwar indem man Daten filtert, aggregiert oder durch Berechnungen anreichert. Durch Filtern der Daten lässt sich die Datensparsamkeit in den Vordergrund stellen und im Vorhinein bestimmen, welche Zeilen und Spalten importiert werden. Auch wenn sich Power BI durch eine Engine auszeichnet, die unter anderem die Daten komprimiert speichert, empfiehlt es sich, nicht alle Daten zu importieren, um dauerhaft eine optimale Performance und Übersichtlichkeit zu haben. Der Vorteil: Das Aktualisieren der Datenquellen wird verkürzt.

Zu beachten ist, dass es sich um eine spaltenorientierte Datenbank-Engine handelt, welche die jeweiligen Spalten in je einem Speicherbereich hält, das bedeutet, weniger Daten, kleinere Speicherbereiche, bessere Indizierung und somit weniger Arbeitsspeicher-Verbrauch sowie bessere Performance. Nutzer, die Datenquellen aus Datenbanken verwenden, die bereits in der Abfrage das Filtern von Daten ermöglichen, sollte diese bevorzugt verwenden. So lassen sich zum Beispiel auch über Sichten beide Filterarten direkt auf dem Server anwenden. Spätere Aggregationen der Daten lassen sich einerseits auf dem Server durchführen, andererseits beim Verbinden weiterer Datenquellen, die nicht aus der Datenbank entnommen werden, innerhalb von Power Query.

Die Modellierung bestimmt die Funktionalität

Was für performante OLAP Cubes gilt, gilt auch für Power BI. Je nach Möglichkeit empfiehlt es sich Star- beziehungsweise Snowflake-Schemata einzusetzen, die dimensional modelliert sind. Dies ermöglicht nicht nur übersichtliche Datenmodelle, sondern auch das Einstellen der Filter-Richtung.

Durch die Filter-Richtungen lässt sich festlegen, ob alle Möglichkeiten dargestellt sind, welche die Dimensionen anbieten oder nur die, die im aktuellen Filter-Kontext noch zur Verfügung stehen. Wenn hingegen alle Daten in einer breiten Tabelle bereitgestellt werden, ist eine solche Einstellung nicht möglich. Nach Möglichkeit sollten Nutzer numerische Schlüsselattribute einsetzen, da das Datenmodell diese schneller verarbeiten kann und sie eine bessere Kompression und Indizierung ermöglichen.

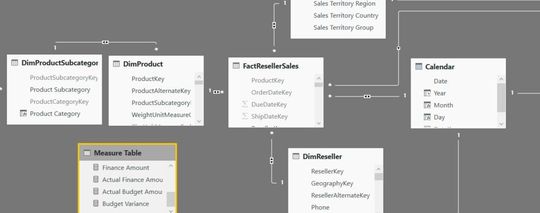

Weiterhin ist es empfehlenswert, auch eine Datumsdimensionstabelle zu verwenden mit der sich zum Beispiel 2-Fakten-Tabellen miteinander verbinden und filtern lassen. Ein Beispiel ist die CALENDAR() Funktion in DAX, die eine entsprechende Tabelle erzeugt und die sich über die Funktionen Day(), Month() etc. ausbauen lässt.

Um das Bedienen zu erleichtern sowie eine Governance von Kennzahlen zu gewährleisten, sollten alle Spalten aus dem Datenmodell ausgeblendet werden, mit denen Kennzahlen gebildet werden können. Dafür sind in DAX entsprechende Measures (berechnete Kennzahlen) zu erstellen, die in einer eigenen Measure-Tabelle abgelegt werden. Dafür wird eine leere Tabelle über den Menüpunkt „Daten eingeben“ erstellt. In dieser Tabelle werden dann die Measures erstellt. Dieses Vorgehen erlaubt es, komplexe sowie einfache Berechnungen im Datenmodell zentral zu platzieren. Dies wird für alle sinnvollen Zahlen, die in den Fakten enthalten sind, durchgeführt, um weiterhin den „Self-Service-BI“ Aspekt zu erhalten. Explizite Measures ermöglichen ein schnelles Wiederverwenden sowie das Sicherstellen der korrekten Berechnung. Damit das alles übersichtlich ist, sollte das Datenmodell noch „feingetuned“ werden, indem alle technischen Spalten, die für Verbindungen zwischen Tabellen notwendig sind, ausgeblendet werden. Jedoch ist hier eine entsprechende Governance eindringlich empfohlen, um auf bestehende Datawarehouse-Lösungen zurückgreifen zu können beziehungsweise auf den dortigen Cubes die vorhandenen berechneten Measures und KPIs wiederverwenden zu können.

Mit Custom Visuals Daten besser präsentieren

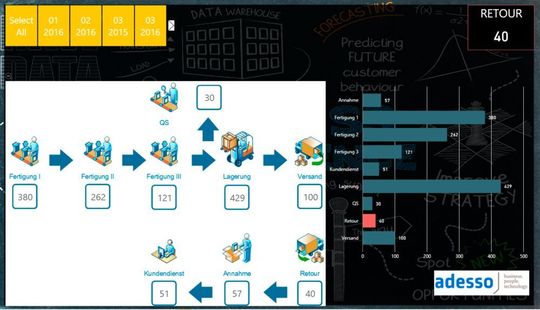

Mit Custom Visuals lassen sich Power-BI-Berichte neben den vorhandenen Visualisierungen ausbauen. Sie stehen in der Galerie zur Verfügung. Die Visualisierungen werden anhand der JavaScript-D3-Bibliothek im Zusammenspiel mit CSS entwickelt. Innerhalb von Power BI können diese durch wenige Klicks integriert werden. Zusätzlich lassen sich über die Webseite des Synoptic Designer individuelle Grafiken erstellen und so zum Beispiel Geschäftsprozesse mit Daten visualisieren.

Verteilen von Dashboards und Berichten

Microsoft Power BI bietet mehre Möglichkeiten, um Dashboards und Berichte zu verteilen. Berichte lassen sich zum einen in sogenannten Arbeitsbereichen organisieren und innerhalb vorhandener Office-365-Gruppen aus dem Azure Active Directory teilen. Zum anderen lassen sich Dashboards innerhalb und außerhalb der Organisation teilen. Letzteres lässt sich einstellen, damit Daten nicht in falsche Hände geraten. Dashboards an Externe zu verteilen ist beispielsweise dann eine interessante Option, wenn Unternehmen Dienstleister oder Zulieferer in ihre Prozesse mit einbinden und über den aktuellen Stand informieren möchten. Als weitere Möglichkeit steht das Veröffentlichen von Berichten ins Internet zur Verfügung. Der Bericht steht als öffentlicher Link zur Verfügung und kann unter anderem als IFrame in eine Webseite eingebunden werden. Zusätzlich bietet Power BI Schnittstellen zum Einbinden der Berichte via REST-Schnittstelle in Webseiten und Apps an.

Integration von Reporting-Services in Power BI

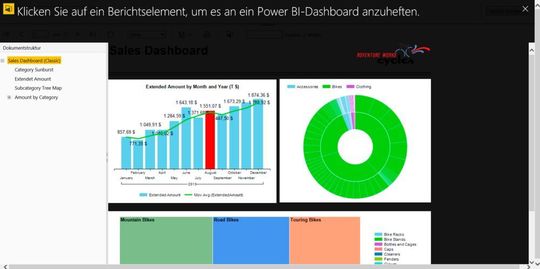

Mit Microsoft SQL Server 2016 kam neuer Schwung in die Reporting-Services-Welt. Neu sind die Mobile Reports. Bei den klassischen Paginated Reports besteht nun die Möglichkeit, den Reporting-Services-Dienst über die Verwaltungskonsole mit einem Power BI Tenant zu verbinden. Von dort können die Benutzer Elemente aus den Berichten an vorhandene Power-BI-Dashboards „anheften“. Voraussetzung ist hierfür jedoch, dass die Datenquellen gespeicherte Anmeldeinformationen beinhalten und sich der jeweilige Benutzer mit seinen Power-BI-Anmeldeinformationen einloggt. Das Einloggen muss der Nutzer alle 90 Tage wiederholen, damit die Aktualisierung weiterhin funktioniert. Ab dem Einloggen aktualisiert der SQL-Server-Agent die Reporting-Services-Kachel vom Bericht automatisch. Sobald der Nutzer auf eine Reporting-Services-Kachel innerhalb eines Power-BI-Berichts klickt, wird er auf den Berichtsserver navigiert. Hierzu ist erforderlich, dass der Benutzer eine Verbindung zum Berichtsserver hat.

(ID:44414963)

:quality(80)/p7i.vogel.de/wcms/e3/95/e39587300e125df30c7917372763139b/0130016264v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/87/b8/87b89fb6ef45cbd96a394a466cd67f23/0130816397v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/59/0b/590bdb8dd7816097e1c233b138c3cf92/0130720216v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/9b/ef/9bef0a77a5695439866debdaba18ba16/0130054146v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2f/b7/2fb7b07cbcbc23a80dcfbe41570c8cf2/0130493230v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a3/72/a3728398797ceec8ea2bca2b17fcd49d/0130470053v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8e/70/8e7083abba5bdaa5b5ab6972670ec5fd/0130190257v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/28/95/289560ddeb2ca55c1e003d57d331063c/0130126830v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/37/af/37af6545336ac8aac53cccaf675c22d5/0116632947v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/34/e734f4d362cad6fc347f5a049b1522db/0129238699v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/35/aa/35aa7935774f380a96e1e3de73c09661/0129631002v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/58/7a/587af12cf063f30f9f1dd8d09a8028ec/0129948269v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e1/53/e1539f6251b6e5502bd1856048c4267e/0128161589v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/d3/dc/d3dc300e714e34706f8e70ac540ebcdc/0130561240v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6f/2d/6f2d2fe91fa2a26ab63377f9ee7af674/0130803635v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b7/0a/b70a5c1423936cec92894bbc0e4b5420/0130683263v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/62/22/6222736cd26d88f18075cdd971cd1541/0129698372v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/80/31/80314a4d3263db61d8adec623a25c627/0130586130v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/a5/f4a5975b3a19ba3b86896a37c23dac7f/0130771937v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/75/da/75daff3c7113e9bfd5c842c2455e3ead/0130146226v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/3d/5b/3d5b7068884a97895ca65ad5ddbff0a8/0130031631v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/dd/f2/ddf24fdae5c827174f24449adf9aaf59/0130927746v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/11/d5/11d57961a97ae85fa56d451a8d29c4fb/0130890936v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/56/3c/563ce9a8669d69d214772cb907fce64d/0130929658v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/99/ba/99ba69a8921df4be68d3e4a900c863cb/0130092667v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d5/59/d5597bab8d5d2a99d6655c93a99ef357/0129935720v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/68/f8/68f8b9869e1288dfa2eeff3a1dc6a7eb/0127838110v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/74/05/74053661b14a2f12ec5e98ebd1469197/0127788138v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c9/1a/c91ad9dfc806cc7df9fe7074ca5e64dd/0127064676v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/43/e4/43e42f37cc71f12e6ae46717e700644e/0126701619v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/82/9a/829ab32db929fbae572a7c8290463a08/0121295821v1.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/61/8e/618e774811e12/logo-disy-mit-slogan.png)

:fill(fff,0)/p7i.vogel.de/companies/64/59/6459ff78aba1f/infomotion-logo-bild-text-rgb.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/67/c6/67c6df851ba69/qunis-profilbild.png)

:quality(80)/p7i.vogel.de/wcms/34/a2/34a2d02781eaabef906c308dd135c049/0130541481v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/7f/fb/7ffb6b273b3f67241d2e365e221d1ca4/0127694438v1.jpeg)