Einfacher, schneller, smarter Apache Spark 2.0 ist da

Unter dem Motto „einfacher, schneller, smarter“ haben die Databricks-Entwickler die finale Version 2 des populären In-Memory-Frameworks Spark veröffentlicht, dessen Code-Basis bei der Apache Software Foundation beheimatet ist.

Anbieter zum Thema

Apache Spark – 2010 initial am AMPLab der University of California in Berkeley entwickelt, seit 2013 ein Apache-Projekt und seit 2014 Top-Level-Projekt der ASF – liegt jetzt offiziell in Version 2.0 vor. Viele der Neuerungen eines der populärsten Big-Data-Frameworks waren Experten allerdings schon bekannt, weil das federführend hinter der Entwicklung von Spark stehenden Unternehmen Databricks im Juni dieses Jahres eine Preview veröffentlicht hatte.

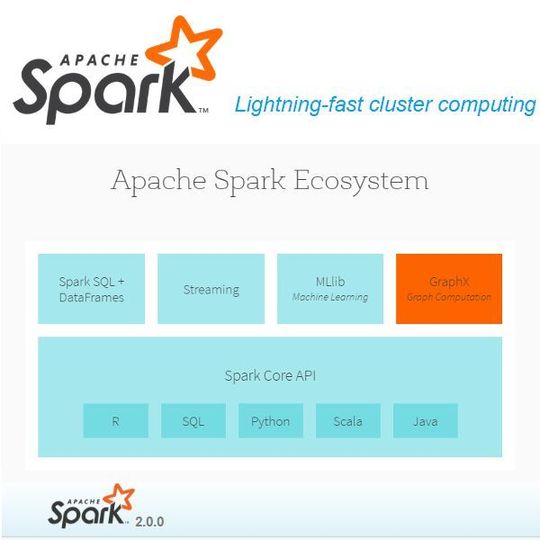

Was Spark ist

Spark wird von zahlreichen namhaften Unternehmen wie Amazon, IBM oder Samsung als Basis-Umgebung für Cluster-Computing produktiv eingesetzt. Im Zentrum des Spark-Frameworks stehen sogenannte Resilient Distributed Datasets (RDD). Hierbei handelt es sich um verteilte, fehlertolerante und parallelisierbare Datenstrukturen, die sich mit zahlreichen verschiedenen Modulen nutzen lassen, wie beispielsweise Streaming (Kafka, HDFS, Flume, ZeroMQ, Twitter), Graphen-Verarbeitung (GraphX) oder Machine Learning. Spark unterstütze ursprünglich die Programmiersprache Scala, inzwischen aber auch Python, Java und R.

Spark kann nicht nur auf Basis von Hadoop/YARN, sondern auch standalone laufen und außerdem auch auf durch Apache Mesos verwalteten Hardware-Clustern.

Neuerungen in Spark 2.0

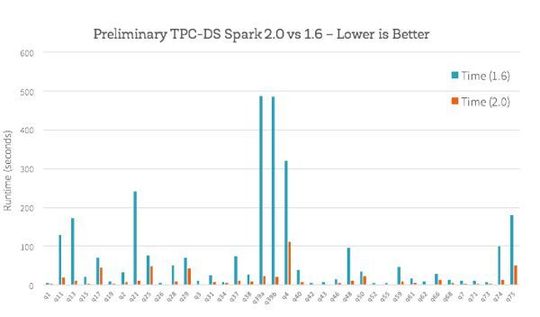

In der Version 2.0 ist das Cluster-Computing-Frameworks einfacher, smarter und schneller geworden, wozu laut Databricks über 300 Mitwirkende mehr als 2.500 Patches, Bugfixes und auch neue Features beigesteuert haben. So kann Spark 2.0 dank Support für SQL 2003 z. B. alle 99 TPC-DS-Queries laufen lassen. Verbessert haben die Entwickler zudem den nativen SQL-Parser, der nun ANSI-SQL und HIVE QL unterstützt.

Ferner bringt Spark 2.0 eine native CSV-Datenquelle mit, die auf dem Spark-CSV-Modul von Databricks basiert. Weitere neue Funktionen sind ein Off-Heap-Speichermanagement für das Caching und das Ausführen von Runtimes sowie die Unterstützung eines Hive-ähnlichen Bucketings.

SparkR

Darüber hinaus bringt Spark 2.0 drei neue, von Anwendern definierte Funktionen dapply, gapply und lapply für SparkR mit. Während sich mit dapply und gapply Partitions-basierte UDFs z. B. für partitioniertes Model Learning nutzen lassen, kann lapply beispielsweise Hyperparameter tunen.

Ferner haben die Entwickler für maschinelles Lernen mit R den Algorithmus-Umfang erweitert. Außerdem ist das Laden und Speichern jetzt für alle ML-Modelle verfügbar. Darüber bekommen generalisierte lineare Modelle mit Spark 2.0 mehr Verknüpfungsfunktionen und Families.

Aktualisierte APIs

Zu den Neuerungen von Spark 2.0 gehören auch aktualisierte und neue APIs. So haben die Entwickler DataFrame und Dataset für Java und Scala zusammengelegt. Für Python und R hingegen ist nun DataFrame die bevorzugte Programmierschnittstelle. Das DataFrame-basierte API ist zudem nun auch in MLib das primäre API. Neuer Einstiegspunkt für DataFrame- und Dataset-APIs ist jetzt SparkSession, das damit SQLContext und HiveContext ersetzt. Allerdings sollen die beiden letztgenannten Einstiegspunkte der Rückwärtskompatibilität wegen weiter Teil von Apache Spark bleiben.

Bessere Performance

Eine wichtige neue Funktion für das Verbessern der Performance ist „Whole-Stage Code Generation“. Dabei wird optimierter Bytecode an die Runtime ausgegeben, welcher das gesamte Query in eine einzige Funktion zusammenfasst. Das vermeidet virtuelle Funktions-Calls und die CPU-Register lassen sich vorteilhaft für das Zwischenspeichern von Daten verwenden.

Artikelfiles und Artikellinks

Link: Weitere Neuerungen im Überblick

Link: Download Spark 2.0

(ID:44199295)

:quality(80)/p7i.vogel.de/wcms/dd/de/ddded0c562bc86a964c72636ce14c0be/0130192405v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e3/95/e39587300e125df30c7917372763139b/0130016264v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/87/b8/87b89fb6ef45cbd96a394a466cd67f23/0130816397v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/59/0b/590bdb8dd7816097e1c233b138c3cf92/0130720216v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2f/b7/2fb7b07cbcbc23a80dcfbe41570c8cf2/0130493230v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a3/72/a3728398797ceec8ea2bca2b17fcd49d/0130470053v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8e/70/8e7083abba5bdaa5b5ab6972670ec5fd/0130190257v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/28/95/289560ddeb2ca55c1e003d57d331063c/0130126830v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/37/af/37af6545336ac8aac53cccaf675c22d5/0116632947v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/34/e734f4d362cad6fc347f5a049b1522db/0129238699v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/35/aa/35aa7935774f380a96e1e3de73c09661/0129631002v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/58/7a/587af12cf063f30f9f1dd8d09a8028ec/0129948269v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e1/53/e1539f6251b6e5502bd1856048c4267e/0128161589v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/d3/dc/d3dc300e714e34706f8e70ac540ebcdc/0130561240v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6f/2d/6f2d2fe91fa2a26ab63377f9ee7af674/0130803635v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b7/0a/b70a5c1423936cec92894bbc0e4b5420/0130683263v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/62/22/6222736cd26d88f18075cdd971cd1541/0129698372v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/1a/81/1a814fa5f0de58d2d61da54aa4b89c6a/0124218373v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/80/31/80314a4d3263db61d8adec623a25c627/0130586130v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/a5/f4a5975b3a19ba3b86896a37c23dac7f/0130771937v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/75/da/75daff3c7113e9bfd5c842c2455e3ead/0130146226v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/1b/3f/1b3f46d2b8086fc51fa997bc1b122854/0131019988v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6d/8a/6d8ad333190915c0d3f19a5463ffab19/0130252150v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/99/ba/99ba69a8921df4be68d3e4a900c863cb/0130092667v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d5/59/d5597bab8d5d2a99d6655c93a99ef357/0129935720v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/68/f8/68f8b9869e1288dfa2eeff3a1dc6a7eb/0127838110v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/74/05/74053661b14a2f12ec5e98ebd1469197/0127788138v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c9/1a/c91ad9dfc806cc7df9fe7074ca5e64dd/0127064676v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/43/e4/43e42f37cc71f12e6ae46717e700644e/0126701619v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/82/9a/829ab32db929fbae572a7c8290463a08/0121295821v1.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/61/8e/618e774811e12/logo-disy-mit-slogan.png)

:fill(fff,0)/p7i.vogel.de/companies/5e/b4/5eb41ddf8e0b6/bdi-insider-logo-2019.png)

:fill(fff,0)/p7i.vogel.de/companies/60/2c/602cdcaa1f5bc/fivetran-logo-blue.png)

:quality(80)/p7i.vogel.de/wcms/28/95/289560ddeb2ca55c1e003d57d331063c/0130126830v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6d/52/6d5292e520f04536ea0123fa420b796d/0125798738v1.jpeg)