Kommentar von Christian Glatschke, Anodot Mathematik schlägt Intuition

Für die Analyse und das Verständnis bestimmter Sachverhalte ist eine kontinuierliche Überwachung bestimmter Einflüsse notwendig. Doch um eine Situation überhaupt untersuchen zu können, muss zunächst festgelegt werden, nach welchen Kriterien diese Beobachtung stattfinden soll. In welchem Bereich spielen sich bestimmte Abläufe ab? Nach welchen Aspekten und Einflüssen muss etwas beobachtet werden, um bestimmte Erkenntnisse gewinnen zu können?

Anbieter zum Thema

In der Informationstechnologie kann das durch Grenzwertdefinitionen für einen oberen oder unteren Bereich stattfinden. So muss bei der Analyse von Unternehmensdaten ein Normalbereich für das Datenverhalten festgelegt werden. Doch woher weiß man, welche Faktoren bei der Festlegung dieser Grenzwerte berücksichtigt werden müssen? Wie erkennt man den Normalbereich der eigenen Unternehmensdaten? Und wenn man nicht weiß, in welchem Bereich sich das ‚Normale‘ bewegt, wie kann anormales Verhalten überhaupt erkannt werden?

Wer sagt eigentlich, was normal ist?

Nicht nur in der Psychoanalytik, sondern auch in anderen Wissenschaften ist es oft schwierig zu bestimmen, welches Verhalten jenseits der Norm liegt. Es gibt häufig keine klar fassbare Trennlinie zwischen dem Normalen und einer Anomalie, weil viele Faktoren oder Dimensionen sich überschneiden und die Abweichungen oft in Kombination auftreten. Wie stark ein Unternehmen oder auch ein Anwendungsfall von einem Ausreißer aus dem Normalbereich betroffen ist und wie dringend Abhilfe geschaffen werden muss, sagen die reinen Zahlen ohnehin nicht aus: Die Auswirkungen, etwa eines Performanzverlustes einer Applikation oder eines kompletten Systemausfalles, können je nach Unternehmen oder Anwendungsfall extrem unterschiedlich sein. Eine Einteilung nach Schema F ist daher oft zu starr, um zuverlässige Ergebnisse zu erhalten.

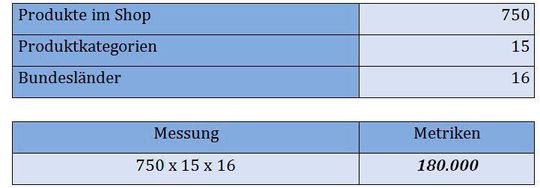

In der Informationstechnologie werden täglich zigtausende von Werten erfasst, überwacht und analysiert. Das Beispiel in Tabelle 1 veranschaulicht, wie schnell die Anzahl der zu messenden Metriken anwachsen kann.

Dies ist ein simplifiziertes Modell für die Bestimmung des Unternehmenserfolges, jedoch wird daran schon ersichtlich wie komplex es werden kann Veränderungen bei bestimmten Produkten, Produktkategorien oder nach Bundesländern in Echtzeit zu erfassen.

Schwellenwerte festlegen – aber wie?

Diese Problemstellung ist natürlich nicht neu und wird bereits mit verschiedensten Herangehensweisen gelöst. Herkömmliche Überwachung basiert in der Regel auf Werkzeugen, die fähig sind, mittels zuvor definierter Schwellwerte, zu überwachen, ob für einen bestimmten Wert Schwankungen vorliegen, die den Normalbereich verlassen. Jedoch ist es in der Regel notwendig, vorab Grenzwerte und Normalbereiche manuell zu definieren. In der täglichen Praxis wird schnell deutlich, dass die Definition von Schwellwerten am Anfang eher aus dem Bauch heraus geschieht. Im Laufe der Zeit müssen diese Werte, basierend auf den sie beeinflussenden Faktoren, kontinuierlich angepasst und neu bestimmt werden. Bei der Anwendung dieser Analysewerkzeuge führt das über längere Zeit jedoch häufig zu einer hohen Anzahl an Fehlalarmen, teilweise hunderte pro Tag, und in deren Folge zu einem ebenso hohen Frustrationsgrad bei allen Beteiligten.

Wir sprechen seit Jahren über Schlagworte wie Big Data, Machine Learning oder automatisierte Analytik und müssen doch in den meisten Fällen immer noch intuitiv Schwellwerte bestimmen. In der täglichen Routine werden aber Lösungen benötigt, die automatisch lernen, welche Metrik im speziellen Umfeld, unter den jeweiligen Bedingungen als normal zu betrachten ist. Eine Softwarelösung, die Machine Learning und Algorithmen nutzt, kann maßgeblich derartige Prozesse für unzählige KPIs und die ordnenden Dimensionen unterstützen. Denn sie erlernt in Echtzeit, in welcher Bandbreite der Normalwert liegt. Der Anwender wird so von zahlreichen Fehlalarmen und manuellen Anpassungen befreit und erhält lediglich nur noch valide Alarmierungen und Meldungen. Ein Alert sollte aber nicht nur darüber informieren, dass etwas im System anormal ist sondern auch gleich die Begründung mitliefern. So kann der Lösungsprozess ebenfalls beschleunigt werden.

Intelligente Algorithmen schaffen Abhilfe

Es gibt verschiedene Algorithmen zur Anomalieerkennung, jedoch ist die Funktions- oder Herangehensweise meistens sehr ähnlich. Zuerst werden Daten während eines Lernzeitraumes beobachtet und analysiert, im nächsten Schritt wird anschließend definiert, welcher Bereich als normal anzusehen ist. Dann identifizieren die Algorithmen in den Daten, die regelmäßig beobachtet werden, jene Werte, die von dem normalen Bereich abweichen. Hierbei gibt es jedoch signifikante Unterschiede zwischen den angewandten Algorithmen: Einerseits hinsichtlich der Geschwindigkeit mit der ein normaler Wertebereich bestimmt, und andererseits hinsichtlich der Subtilität, mit der der Normalbereich definiert wird. Fakt ist jedoch, dass Unternehmen bei der richtigen Wahl und Anwendung der jeweiligen Algorithmen von enormen Vorteilen in Anwendungsfällen wie E-Commerce, IoT oder IT-Betrieb profitieren. Werden hingegen falsche Algorithmen angewendet, kann daraus eine unbeherrschbar hohe Anzahl von Fehlalarmen ausgelöst werden.

Aus diesem Grund wird eine Lösung benötigt, die sowohl eine Vielfalt an Algorithmen mit sich bringt, als auch die notwendige Intelligenz im jeweiligen Bedarfsfall den richtigen Algorithmus anzuwenden.

Anodot bietet eine Lösung an, mit der Anomalien und Business Incidents automatisiert erfasst werden. Mit seinen Algorithmen, welche zum größten Teil auf eigener Entwicklung beruhen, stellt Anodot sicher, dass Millionen von Metriken in Echtzeit aggregiert und analysiert werden können. Dabei wird durch intelligentes Scoring und die automatische Gruppierung aufeinander beruhender Anomalien und Vorfälle, eine Minimierung unnötiger Alarme sichergestellt. Das System ist fähig nach Maß zu agieren, da die Datenströme in Echtzeit überwacht werden, die Algorithmen das Verhalten dieser Daten erlernen bzw. das bereits Erlernte darauf anwenden und sogar weiterentwickeln. Dem Anwender wird somit ein System zur Verfügung gestellt, das sowohl den Bereichen Data Science, Business Intelligence, IT-Betrieb und IT-Security enorme Vorteile als auch Ersparnisse im täglichen Betrieb bietet.

Artikelfiles und Artikellinks

Link: Anodot im Web

(ID:44559870)

:quality(80)/p7i.vogel.de/wcms/dd/de/ddded0c562bc86a964c72636ce14c0be/0130192405v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e3/95/e39587300e125df30c7917372763139b/0130016264v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/87/b8/87b89fb6ef45cbd96a394a466cd67f23/0130816397v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/59/0b/590bdb8dd7816097e1c233b138c3cf92/0130720216v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2f/b7/2fb7b07cbcbc23a80dcfbe41570c8cf2/0130493230v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a3/72/a3728398797ceec8ea2bca2b17fcd49d/0130470053v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8e/70/8e7083abba5bdaa5b5ab6972670ec5fd/0130190257v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/28/95/289560ddeb2ca55c1e003d57d331063c/0130126830v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/37/af/37af6545336ac8aac53cccaf675c22d5/0116632947v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/34/e734f4d362cad6fc347f5a049b1522db/0129238699v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/35/aa/35aa7935774f380a96e1e3de73c09661/0129631002v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/58/7a/587af12cf063f30f9f1dd8d09a8028ec/0129948269v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e1/53/e1539f6251b6e5502bd1856048c4267e/0128161589v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/d3/dc/d3dc300e714e34706f8e70ac540ebcdc/0130561240v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6f/2d/6f2d2fe91fa2a26ab63377f9ee7af674/0130803635v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b7/0a/b70a5c1423936cec92894bbc0e4b5420/0130683263v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/62/22/6222736cd26d88f18075cdd971cd1541/0129698372v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/1a/81/1a814fa5f0de58d2d61da54aa4b89c6a/0124218373v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/80/31/80314a4d3263db61d8adec623a25c627/0130586130v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/a5/f4a5975b3a19ba3b86896a37c23dac7f/0130771937v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/75/da/75daff3c7113e9bfd5c842c2455e3ead/0130146226v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/1b/3f/1b3f46d2b8086fc51fa997bc1b122854/0131019988v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6d/8a/6d8ad333190915c0d3f19a5463ffab19/0130252150v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/99/ba/99ba69a8921df4be68d3e4a900c863cb/0130092667v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d5/59/d5597bab8d5d2a99d6655c93a99ef357/0129935720v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/68/f8/68f8b9869e1288dfa2eeff3a1dc6a7eb/0127838110v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/74/05/74053661b14a2f12ec5e98ebd1469197/0127788138v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c9/1a/c91ad9dfc806cc7df9fe7074ca5e64dd/0127064676v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/43/e4/43e42f37cc71f12e6ae46717e700644e/0126701619v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/82/9a/829ab32db929fbae572a7c8290463a08/0121295821v1.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/68/2d/682dd583dcc4c/fsas-afc-horizontal-2-positive-rgb-nov24.png)

:quality(80)/p7i.vogel.de/wcms/1d/a5/1da5ee3d7b323edcdf5aab97e8e1b6b5/0130407684v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/52/ff/52ff0b43815f59e6b39df610829b002f/0125624909v1.jpeg)