Kommentar von Hilmar Buchta, Oraylis Künstliche Intelligenz verschlagwortet Produktbilder

Als führende Handelskooperation für Bekleidung muss die ANWR Group laufend Produktangaben für die Präsentation in Web-Shops manuell erfassen – ein sehr zeitintensives und aufwendiges Verfahren. Infolgedessen hat das Unternehmen eine Bilderkennung für Schuhe entwickelt, die über die Produktfotos alle relevanten Angaben generiert. Basis bildet ein vortrainiertes Modell, dessen angelerntes Wissen zum Teil auf die neue Aufgabenstellung übertragen werden konnte.

Anbieter zum Thema

Eine anwenderfreundliche Produktsuche zählt zu den wichtigsten Erfolgsfaktoren von Shopping-Portalen für Bekleidung. Kunden wollen nicht nur nach Marken filtern, sondern nach ganz spezifischen Merkmalen, wie Farben, Schnittformen oder der Höhe eines Schuhabsatzes. Infolgedessen sind die Händler gefordert, ihr vollständiges Angebot mit entsprechenden Metadaten zu versehen.

Da die Hersteller uneinheitliche und sehr grobe Kategorisierungen verwenden, müssen die erforderlichen Angaben meist unter großem Aufwand manuell erfasst werden. Diese Vorgehensweise ist nicht nur zeitintensiv, sondern auch fehleranfällig – insbesondere, wenn zum Saisonwechsel eine Vielzahl neuer Produkte erscheinen.

Vor diesem Hintergrund hat die ANWR Group gemeinsam mit Oraylis ein vielversprechendes Analysemodell auf Basis Künstlicher Intelligenz entwickelt: eine Bilderkennung für Schuhe. Die ANWR Group zählt europaweit zu den führenden Handelskooperationen für Schuhe, Sportartikel und Lederwaren. Das Unternehmen ist unter anderem Betreiber des Web-Shops „schuhe.de“. Insofern bedeutet das Modell eine umfassende Erleichterung: Eintreffende Ware lässt sich nunmehr allein über die Produktfotos automatisch verschlagworten. Bei der Modellentwicklung wurde eine Vorgehensweise auf Basis von Transfer Learning gewählt, die einerseits Aufwand einspart und andererseits zu zuverlässigen Analyseergebnissen führt.

100.000 Produkte als Trainingsgrundlage

Mehr als 6.000 Unternehmen mit über 11.000 Fachgeschäften in ganz Europa nutzen das Waren-, Marketing- und Serviceangebot der ANWR Group. Entsprechend umfangreich ist das Trainingsmaterial, das für den Aufbau des Modells zur Verfügung steht. Insgesamt handelt es sich um rund 75.000 verschiedene Schuhe aus aktuellen Kollektionen. Hinzu kommen circa 20.000 alte Produkte.

Für die Präsentation in den Web-Shops fotografiert die ANWR Group die Schuhe standardmäßig aus 20 Perspektiven. Im Kontext des Modelltrainings kommen jeweils zehn dieser Perspektiven zum Einsatz. Auf Vorder- und Rückansichten wird beispielsweise verzichtet, da Schuhe aus diesen Blickwinkeln nur schwerlich zu identifizieren sind. So wird das Modell letztendlich mithilfe von etwa 700.000 Bildern trainiert.

Grundsätzlich verlangt ein solches Training nach hohen Rechenleistungen. Durch die im weiteren beschriebene Vorgehensweise des Transfer Learnings konnte die Hardware aber relativ einfach gehalten werden. Als Trainingsumgebung diente ein Linux-Server mit sechs Kernen und 56 Gigabyte RAM-Speicher. Für weitere Beschleunigung sorgt eine Nvidia-Tesla-K80-Grafikkarte, die für diese Art von Rechenoperationen optimiert ist. Es handelt sich um eine virtuelle Maschine aus der Cloud, sodass die Investitionen in diesem Bereich überschaubar gehalten werden.

Generalistisches Modell individuell trainiert

Normalerweise nimmt also die Entwicklung eines Modells zur Bilderkennung eine immense Zeit in Anspruch. Aufgrund der Vielzahl der zu erlernenden Muster kann die Trainingsphase selbst auf spezialisierter Hardware mehrere Wochen oder gar Monate dauern. Eine Alternative bilden vortrainierte Modelle. Diese sind allerdings eher generalistisch ausgelegt. Beispielsweise können sie Schuhe, Hosen oder Jacken voneinander unterscheiden. Um welche Marke es sich handelt, lässt sich meist schon nicht mehr bestimmen.

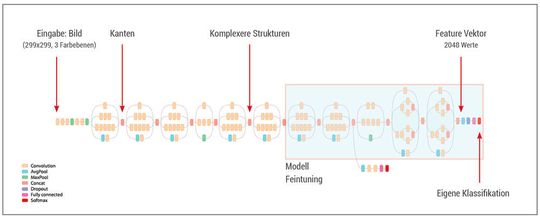

Daher kommt bei der ANWR Group eine Mischform der beiden Ansätzen zur Anwendung, die auf der Methode des Transfer Learnings beruht. Ausgangspunkt bildet das TensorFlow Framework mit einer Inception-v3-Architektur, einem Deep-Learning-Modell über 48 Schichten. Bei Inception v3 handelt es sich um einen prominenten Vertreter der Convolutional Neural Networks (CNN), mit denen der Durchbruch bei der Bilderkennung gelungen ist. Sie zerlegen die Bilder in kleinere Bestandteile und erkennen in der Folge, welche Bildausschnitte relevant sind.

Für Inception v3 im Speziellen spricht, dass das Netzwerk inzwischen – etwa zwei Jahre nach Veröffentlichung – sehr gut erforscht und entsprechend gut handzuhaben ist. Zum anderen bildet das Modell einen guten Kompromiss zwischen Komplexität und Einfachheit – heißt: Die durchaus anspruchsvollen Anforderungen einer Bilderkennung für Schuhe lassen sich damit bewältigen. Dennoch ist das Training bei der vorhandenen Anzahl an Schichten nicht zu aufwendig.

Vor allem aber existiert zu diesem Modell bereits angelerntes Wissen. Es wurde auf Basis der Bilddatenbank ImageNet vortrainiert. Dadurch verfügt es über die Fähigkeit, allgemeingültige Bildelemente zu erfassen, wie Kanten oder Flächenformen. Dieser Teil des angelernten Wissens lässt sich dann auch auf den vorliegenden Anwendungsfall anwenden bzw. „transferieren“. Das Modell muss hier also nicht mehr von Grund auf trainiert werden.

Weitere Schichten gilt es indes auf die eigene Aufgabenstellung hin zu modifizieren. Dazu werden die vorhandenen Schlagworte auf die Produkteigenschaften des Shopping-Portals angepasst. Mithilfe der Bilddaten wird das Modell dann über mehrere Phasen hinweg trainiert und immer feiner justiert.

Besonderheiten der Farberkennung

Fünf verschiedene Produkteigenschaften stehen beim Modelltraining im Fokus: Farbe, Kategorie, Saison, Absatzhöhe und Marke. Eine besondere Herausforderung stellt die Farbe dar. Viele Farbtönen sind schwer zu unterscheiden, wie etwa weiß und beige. Manches Schuhwerk ist sogar mehrfarbig. Zudem ist die vorherrschende Bildfarbe nicht zwangsläufig die Produktfarbe. Bestes Beispiel sind Sandalen. Hier nimmt die Farbe der Innensole einen deutlich größeren Bildbereich ein, als die Farbe der Riemen. Letztere ist aber für die Einordnung des Produktes entscheidend. Der Algorithmus muss somit auch dazu in der Lage sein, die relevanten Bildbereiche zu erkennen. Diese Besonderheiten gilt es in Form eines intensiveren Modelltrainings zu berücksichtigen. Gleichzeitig muss natürlich auch das Modell als solches komplex genug sein, um solche Stellen bzw. Feinheiten zur erkennen.

Das Modell unterscheidet im Ganzen zwischen 20 Farbkategorien. Für das Training ist es erforderlich, zunächst die unterschiedlichen Kategorien hinsichtlich der Mengen aneinander anzupassen. Denn: Jede Farbe sollte mit der gleichen Anzahl an Schuhbildern trainiert werden. Da Farben jedoch der Mode unterworfen sind, variierte der Umfang des zur Verfügung stehenden Materials teilweise stark. Infolgedessen werden die „großen Kategorien“ reduziert, indem nicht alle Bilder zum Einsatz kamen. „Kleinere“ Farbkategorien lassen sich indes durch Modifikationen und mehrfache Verwendung erweitern. So werden die Bilder in einem Spektrum von -15 bis +20 Prozent vergrößert, verkleinert oder zufällig gedreht. Darüber hinaus wird nach dem Zufallsprinzip ein neuer Hintergrund in das Bild montiert. Dieses Vorgehen führt zu einem robusteren Modell. Es lernt, dass der Winkel oder der Hintergrund bei der Erkennung von Schuhen keine Rolle spielt.

Dank Transfer Learning hat das Training der Farbe lediglich drei Tage in Anspruch genommen. Hätte das Modell neu aufgebaut werden müssen, wären auf der hier genutzten Hardware rund 50 Tage erforderlich gewesen. Ursprünglich sollten die Trainingszeiten sogar noch kürzer sein. In den ersten Testläufen wurde zunächst ausschließlich die letzte Schicht – also die 48. – des Modells neu justiert. Allerdings mit wenig zufriedenstellenden Ergebnissen: Die Trefferquote bei der Farbe lag nur bei 40 Prozent. Dem entsprechend wurde das Training vertieft und auf weitere Schichten ausgeweitet. Letztlich ist die komplette zweite Hälfte des Modells einem Finetuning unterzogen worden.

Weitere relevante Produkteigenschaften

Bei den anderen vier Produkteigenschaften wird ähnlich verfahren, wie bei der Farbe. Wobei die zahlenmäßige Anpassung der verschiedenen Ausprägungen leichter fällt. So sind bei der ANWR Group grundsätzliche Kategorien, wie „Damenschuhe“ und „Herrenschuhe“, per se mit einer Hierarchisierung unterlegt. Im Bereich der Damenschuhe ist das beispielweise „Damenstiefel > Damenwesternstiefel“. Kleine, sehr spezielle Kategorien bzw. Hierarchieebenen können dadurch einfach zusammengefasst werden. In der Folge erkennt das Modell 120 unterschiedliche Hierarchieausprägungen.

Noch einfacher gestaltet sich das Vorgehen bei „Saison“ und „Absatzhöhe“. In ersterem Fall gibt es lediglich eine Unterscheidung zwischen „Frühjahr/Sommer“, „Herbst/Winter“ sowie „Ganzjährig“, in letzterem zwischen „0 cm“, „bis 4 cm“, „bis 8 cm“ und „über 8 cm“. Es existieren also relativ wenige Ausprägungen, die sich entsprechend leichter bzw. genauer bestimmen lassen. Schließlich wird das Modell noch auf rund 100 verschiedene Marken trainiert. Verbleibende Marken werden unter „Unbekannt“ zusammengezogen. Dabei lässt sich natürlich feststellen, dass auffällige Schuhe – wie Sneakers – wesentlich einfacher zu trainieren sind, als dezente Modellinien mit weniger Unterscheidungsmerkmalen, wie zum Beispiel Business-Lederschuhe für Herren.

Bessere Stammdaten als Benefit

Am Ende dieses intensiven Trainings steht ein Modell, das die Eigenschaften einzelner Produkte mit bemerkenswerter Präzision ermittelt. Und: Die Bilderkennung ist nicht auf professionelle Produktfotos beschränkt. Sie funktioniert ebenso bei selbstgeschossenen Smartphone-Bildern.

Aktuell lässt sich dennoch ein gewisser manueller Aufwand nicht vermeiden. So gibt das Modell die Ergebnisse seiner Bildanalysen immer in Verbindung mit einer Wahrscheinlichkeit an. Liegt diese Wahrscheinlichkeit bei über 90 Prozent, ist die Angabe im Regelfall korrekt. Werte zwischen 70 und 90 Prozent sind als Vorschlag für eine manuelle Eingabe zu betrachten. Bei unter 70 Prozent ist indes eine manuelle Prüfung und Eingabe unumgänglich.

Im Gegenzug bietet sich die Möglichkeit, die Qualität der Stammdaten zu steigern. Weicht ein „sicheres“ Analyseergebnis von bereits vorhandenen Informationen ab, dann ist das ein zuverlässiger Hinweis auf einen Fehler im Datenbestand. Die auf diese Weise korrigierten Stammdaten fließen wiederrum in das Modell ein, sodass schrittweise für Verbesserungen gesorgt wird.

Fazit

Die Erschließung und Nutzung von Bildern ist in der unternehmensweiten Datenanalyse noch deutlich unterrepräsentiert – ein Phänomen, das bei unstrukturierten Daten häufig zu beobachten ist. Viele Unternehmen wissen nicht, wie sie das Thema angehen können. Sie fürchten hohe Aufwände und sind sich im Unklaren über die richtigen Anwendungsfälle.

Die Dienste der großen Anbieter – wie zum Beispiel Amazon Recognition oder Microsoft Cognitive Services – bieten in diesem Kontext keine große Unterstützung. Sie können eine Kirche von einem Strand unterscheiden und eignen sich somit für die Klassifizierung von Urlaubsbildern. Von der Identifikation und Analyse einer Damensandalette sind sie indes weit entfernt.

Dabei können Bilddaten einen erheblichen Mehrwert bieten, wie unser Beispiel gezeigt hat. Die ANWR Group profitiert massiv von der neuen Lösung. Gleichzeitig zeigt das Projekt, dass die Entwicklung einer Bilderkennung nicht zwingend mit hohen Aufwänden verbunden sein muss. Insgesamt hat die Modellentwicklung nur rund vier Wochen in Anspruch genommen. Durch den Einsatz von Transfer Learning wurde ein Großteil des Trainingsaufwands eingespart und gleichzeitig ein sehr spezialisiertes Modell für Bekleidung erzeugt. Ebenso vereinfachen Speicher- und Rechenressourcen aus der Cloud die Abläufe ungemein. Nicht zuletzt lässt sich diese Vorgehensweise auf viele andere Anwendungsfälle übertragen.

Wie aber können Unternehmen solche Ansätze selber initiieren? Grundsätzlich ist hierfür umfangreiches Wissen aus den Bereichen KI und Deep Learning erforderlich. Der Aufbau eigenen Know-hows lohnt sich aber nur dann, wenn solche Anwendungsfälle häufiger auftreten. Ansonsten empfiehlt sich die Zusammenarbeit mit einem kompetenten Partner, wie es auch in unserem Beispiel der Fall war. Hier waren die Aufgaben klar verteilt: Das vollständige Modell – inklusive Training und Nachtraining – wurde vom Dienstleister geliefert. Die Integration in die laufenden Prozesse erfolgte schließlich auf Seiten der ANWR Group.

(ID:45423190)

:quality(80)/p7i.vogel.de/wcms/dd/de/ddded0c562bc86a964c72636ce14c0be/0130192405v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e3/95/e39587300e125df30c7917372763139b/0130016264v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/87/b8/87b89fb6ef45cbd96a394a466cd67f23/0130816397v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/59/0b/590bdb8dd7816097e1c233b138c3cf92/0130720216v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2f/b7/2fb7b07cbcbc23a80dcfbe41570c8cf2/0130493230v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a3/72/a3728398797ceec8ea2bca2b17fcd49d/0130470053v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8e/70/8e7083abba5bdaa5b5ab6972670ec5fd/0130190257v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/28/95/289560ddeb2ca55c1e003d57d331063c/0130126830v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/37/af/37af6545336ac8aac53cccaf675c22d5/0116632947v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/34/e734f4d362cad6fc347f5a049b1522db/0129238699v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/35/aa/35aa7935774f380a96e1e3de73c09661/0129631002v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/58/7a/587af12cf063f30f9f1dd8d09a8028ec/0129948269v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e1/53/e1539f6251b6e5502bd1856048c4267e/0128161589v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/d3/dc/d3dc300e714e34706f8e70ac540ebcdc/0130561240v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6f/2d/6f2d2fe91fa2a26ab63377f9ee7af674/0130803635v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b7/0a/b70a5c1423936cec92894bbc0e4b5420/0130683263v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/62/22/6222736cd26d88f18075cdd971cd1541/0129698372v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/80/31/80314a4d3263db61d8adec623a25c627/0130586130v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/a5/f4a5975b3a19ba3b86896a37c23dac7f/0130771937v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/75/da/75daff3c7113e9bfd5c842c2455e3ead/0130146226v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/3d/5b/3d5b7068884a97895ca65ad5ddbff0a8/0130031631v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c6/de/c6de64af2c6001131a4677f157a8fac5/0130960706v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b2/33/b2336808367c4d2c6e4fb7b4e5a0d573/0130876852v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/99/ba/99ba69a8921df4be68d3e4a900c863cb/0130092667v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d5/59/d5597bab8d5d2a99d6655c93a99ef357/0129935720v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/68/f8/68f8b9869e1288dfa2eeff3a1dc6a7eb/0127838110v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/74/05/74053661b14a2f12ec5e98ebd1469197/0127788138v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c9/1a/c91ad9dfc806cc7df9fe7074ca5e64dd/0127064676v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/43/e4/43e42f37cc71f12e6ae46717e700644e/0126701619v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/82/9a/829ab32db929fbae572a7c8290463a08/0121295821v1.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/64/59/6459ff78aba1f/infomotion-logo-bild-text-rgb.jpeg)

:quality(80)/p7i.vogel.de/wcms/b7/9f/b79f93c561b741b84223d4ad854d69e2/0128366406v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/02/aa/02aaed60e00099891102bfd31eeb3db2/0124989319v1.jpeg)