Intel Xeon Scalable der 3. Generation Für KI und große Datenbanken: Intels Cooper-Lake-CPU

Die dritte Generation von Intels Xeon-Scalable-Prozessoren ist für Server mit vier oder acht Sockets bestimmt. Die Cooper-Lake-CPUs kommen mit einem erweiterten Intel Deep Learning Boost für KI-Anwendungen. Zudem sind in Kombination mit Optane PMem bis zu 18 TB Speicher in 4-Socket-Systemen möglich.

Anbieter zum Thema

Als Weiterentwicklung der Cascade-Lake-Familie bringt Intel für Server mit mindestens vier Sockets die Xeon-Scalable-Prozessoren der dritten Generation auf den Markt. Insgesamt elf CPUs zählen zu dieser neuen Cooper-Lake-Generation: Fünf Xeon-Gold-Modelle mit 16 bis 24 Cores für 4-Socket-Systeme und sechs Xeon-Platinum-Prozessoren für Server mit bis zu acht CPU-Sockeln. Sie verfügen über 18 oder 28 Cores. Die CPUs bieten wie bei Cascade-Lake jeweils 48 PCI-Express-3.0-Lanes und sechs DDR4-Speicherkanäle. Bei einem Speichermodul pro Kanal wird nun auch DDR4-3200 unterstützt. Für eine schnellere Verbindung zwischen den CPUs auf dem Mainboard sorgt die Verdoppelung der Zahl der UPI-Links von drei auf sechs. Ultra Path Interconnect (UPI) hat bei den Xeon-CPUs mit FCLGA3647 die bisher eingesetzten QPI-Links ersetzt.

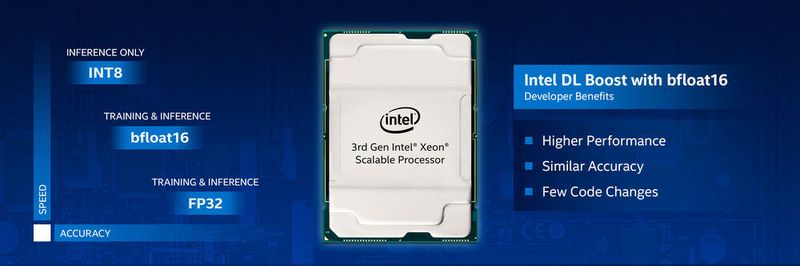

Deep Learning Boost mit BFloat16

Während Intel mit Xeon bei der Anzahl der Cores pro Socket und der PCI-Express-Performance gegenüber AMDs Epyc der Rome-Generation klar ins Hintertreffen geraten ist, hat der Chip-Hersteller bei der Unterstützung von KI-Anwendungen durch spezielle CPU-Funktionen die Nase vorn. Denn hier hat AMD noch nichts zu bieten. Bei Cooper Lake wurde der bisher aus den Vector Neural Network Instructions (VNNI) für AVX-512 bestehende Deep Learning Boost (DLBoost) um die Unterstützung des BFloat16-Datenformats (BF16) ergänzt. Mit ihm lässt sich laut Intel die Geschwindigkeit bei KI-Training und Inferenz gegenüber FP32 um den Faktor 1,9 steigern. Die Genauigkeit sinke dabei nur minimal. Die Cooper-Lake-Xeons sind die ersten x86-CPUs mit BF16-Unterstützung. Die jüngst von Nvidia vorgestellte A100-GPU wartet ebenfalls mit BF16-Unterstützung auf.

Mehr Speicher mit Optane PMem 200

Die HL-Varianten der neuen Xeon-Scalable-Prozessoren unterstützen die neue Optane-Persistant-Memory-200-Serie von Intel, die eine um 25 Prozent höhere Datentransferrate im Vergleich zum Vorgänger liefern soll. Die nichtflüchtigen Speichermodule mit Optane-Memory (PMem) sind weiterhin in Modulgrößen zwischen 128 GB und 512 GB verfügbar. Sie können in den Speicherslots anstelle von DDR4-Modulen eingesetzt werden, um die Größe der Arbeitsspeicher zu steigern und Daten persistent zu halten. Pro CPU-Sockel sind 4,5 TB kombinierter Speicher möglich, 1,5 TB DDR4 und 3 TB PMem. Profitieren sollen etwa große In-Memory-Datenbanken wie SAP Hana, aber auch Oracle-Datenbanken durch schnellere Abfagen. Zudem können mehr VMs gleichzeitig laufen, und Data-Analytics-Anwendungen wie Apache Spark sollen schneller Ergebnisse liefern.

KI-FPGA: Stratix 10 NX

Ein weiterer Baustein in Intels KI-Strategie ist der gemeinsam mit Cooper Lake vorgestellte FPGA-Chip Stratix 10 NX. Dieser erste für KI-Anwendungen optimierte FPGA von Intel wartet mit speziellen AI-Tensor-Einheiten, einem 3D-Package mit HBM2-Speicher und einer schnelleren Netzwerkanbindung auf.

(ID:46669826)

:quality(80)/p7i.vogel.de/wcms/c2/46/c2467c63f76bb87b95a0325250d912bf/0130876149v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/dd/de/ddded0c562bc86a964c72636ce14c0be/0130192405v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e3/95/e39587300e125df30c7917372763139b/0130016264v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/87/b8/87b89fb6ef45cbd96a394a466cd67f23/0130816397v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2f/b7/2fb7b07cbcbc23a80dcfbe41570c8cf2/0130493230v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a3/72/a3728398797ceec8ea2bca2b17fcd49d/0130470053v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8e/70/8e7083abba5bdaa5b5ab6972670ec5fd/0130190257v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/28/95/289560ddeb2ca55c1e003d57d331063c/0130126830v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/37/af/37af6545336ac8aac53cccaf675c22d5/0116632947v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/34/e734f4d362cad6fc347f5a049b1522db/0129238699v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/35/aa/35aa7935774f380a96e1e3de73c09661/0129631002v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/58/7a/587af12cf063f30f9f1dd8d09a8028ec/0129948269v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e1/53/e1539f6251b6e5502bd1856048c4267e/0128161589v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/d3/dc/d3dc300e714e34706f8e70ac540ebcdc/0130561240v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6f/2d/6f2d2fe91fa2a26ab63377f9ee7af674/0130803635v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b7/0a/b70a5c1423936cec92894bbc0e4b5420/0130683263v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/62/22/6222736cd26d88f18075cdd971cd1541/0129698372v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/1a/81/1a814fa5f0de58d2d61da54aa4b89c6a/0124218373v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/80/31/80314a4d3263db61d8adec623a25c627/0130586130v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/a5/f4a5975b3a19ba3b86896a37c23dac7f/0130771937v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/75/da/75daff3c7113e9bfd5c842c2455e3ead/0130146226v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/00/8c/008c34ca8e56a619ec65a39e2c25968a/0130742391v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/34/15/341501a63d2b9874945f1d5ce6739b3e/0131062134v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2b/1e/2b1e0c9bcb544b458cf9a83c11a4e14b/0131065662v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/99/ba/99ba69a8921df4be68d3e4a900c863cb/0130092667v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d5/59/d5597bab8d5d2a99d6655c93a99ef357/0129935720v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/68/f8/68f8b9869e1288dfa2eeff3a1dc6a7eb/0127838110v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/74/05/74053661b14a2f12ec5e98ebd1469197/0127788138v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c9/1a/c91ad9dfc806cc7df9fe7074ca5e64dd/0127064676v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/43/e4/43e42f37cc71f12e6ae46717e700644e/0126701619v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/82/9a/829ab32db929fbae572a7c8290463a08/0121295821v1.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/66/72/6672da9970fc4/board-logo-2024.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/67/c6/67c6df851ba69/qunis-profilbild.png)

:fill(fff,0)/p7i.vogel.de/companies/60/2c/602cdcaa1f5bc/fivetran-logo-blue.png)

:quality(80)/images.vogel.de/vogelonline/bdb/1718500/1718519/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1718500/1718520/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1718500/1718521/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1718500/1718522/original.jpg)

:quality(80)/p7i.vogel.de/wcms/8a/58/8a589b0e6274aaa0550b3fd6dbfa3b59/0128790332v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/55/00/550007979508377a91017d5d9625a7e5/0129898368v2.jpeg)