Schemafreie SQL-Abfragen für Hadoop und NoSQL Big Data mit Apache Drill

Das Thema Informationsgewinnung und Abfragen in Big-Data-Lösungen ist nicht immer einfach. Unternehmen sollten hier einen Blick auf die Open-Source-Lösung Apache Drill werfen.

Anbieter zum Thema

Apache Drill erweitert Hadoop-Umgebungen und NoSQL-Datenbanken um die Möglichkeit, SQL-Abfragen zu erstellen. Grundlage von Drill ist das Google-Produkt Dremel, welches Daten mit hoher Geschwindigkeit aus schemafreien SQL-Datenbanken abfragen kann. Im Fokus der Google-Lösung stehen Echtzeit-Abfragen und Ad-hoc-Berichte in BI- oder Big-Data-Umgebungen.

Drill ist vollständig kompatibel mit ANSI SQL und es sind keine Schemas in den Datenbanken notwendig, was bei NoSQL-Datenbanken die Regel ist. Apache Drill lässt sich parallel zu SQL und BI Tools einsetzen und unterstützt auch JDBC und ODBC.

Das Projekt gehört mittlerweile zu den Top-Level-Projekten von Apache, wird also als weit gehend stabil und fehlerfrei angesehen. Dem Einsatz in produktiven Umgebungen steht nichts entgegen. Drill kann, wie auch Hadoop, auf riesige Datenmengen im Petabyte-Bereich zugreifen, die auf tausende Clusterknoten verteilt vorliegen können. Die Leistung soll dabei nicht einbrechen.

Der bekannte Hadoop-Distributor MapR hat im vergangenen Jahr über 100 Millionen US-Dollar Risikokapital eingesammelt, um die Projekte Hadoop, Spark und Drill enger miteinander zu verzahnen. An der Technologie arbeitet daher nicht nur die sehr aktive Community, sondern auch potente Unternehmen, die sich in diesem Bereich bereits einen Namen gemacht haben. Zu den Geldgebern gehört unter anderem auch Google. MapR will Apache Drill zum Abfrage-Standard für Hadoop machen.

Einstieg in Apache Drill

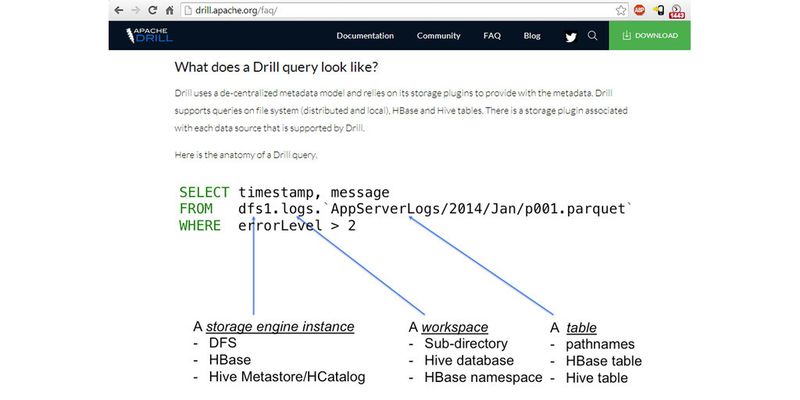

Apache Drill ist in der Lage, einfache Analysen und Abfragen durchzuführen, kann aber auch in Batch-Prozessen und Pipelines eingebunden werden, wenn es um komplexere Berechnungen geht. Die Abfrage-Sprache wird auch als DrQL bezeichnet. Vorteil der Lösung ist die Unterstützung von SQL-gängigen Abfragen. Das heißt, Entwickler können sich sehr schnell in das Produkt einarbeiten und erhalten schnell zuverlässige Abfragen.

Als Datenspeicher kann Drill direkt an Hadoop angebunden werden und unterstützt in dieser Hinsicht auch das Hadoop File System (HDFS), aber auch HBase wird unterstützt. In Zukunft soll Apache Drill enger mit Apache Spark zusammenarbeiten. Da Spark im Grunde genommen der Nachfolger von MapReduce ist, wird diese Technik in immer mehr Big-Data-Infrastrukturen eingesetzt. Neben NoSQL lassen sich auch andere NoSQL-Datenbanken abfragen, zum Beispiel MongoDB. Drill unterstützt, im Gegensatz zu seinem Quell-Produkt Dremel, dabei sowohl spalten- als auch zeilenbasierte Formate.

Schnellere Datenanalyse

Drill soll vor allem dabei helfen, Abfragen und Informationen schneller zu erhalten als mit Bordmitteln über MapReduce. Zusammen mit Apache Spark kann Drill sogar noch schnellere Informationen liefern. Durch die Möglichkeit, Daten wie Parquet, JSON und HBase-Tabellen nutzen zu können und auch noch Direktabfragen zu bieten, ohne dass Schemas definiert werden müssen, eignet sich das System für schnelle Datenanalysen.

Durch die Zusammenarbeit mit verschiedenen Speichertreibern und SQL-Datenbanken oder BI-Tools eignet sich Drill auch hervorragend als Schnittstelle zwischen herkömmlichen Speichersystemen, Business-Intelligence-Lösungen und Big-Data-Infrastrukturen.

Entwicklungen 2015 – Zugriffskontrolle und mehr Datenquellen

Bereits dieses Jahr wollen die Entwickler noch mehr Datenquellen an Drill anbinden können. Geplant sind die Unterstützung von Cassandra und Solr sowie mehr Möglichkeiten mit JDBC. Auf diesem Weg sollen sich alle Datenbank-Server anbinden lassen, auch MySQL, Oracle, und Microsoft SQL-Server. Außerdem soll die Zugriffskontrolle flexibler gestaltet werden können und die SQL-Abfragen sollen erweitert werden. Die Geschwindigkeit soll gesteigert werden und die Integration in Apache Spark soll weiter vorangetrieben werden. Die Entwickler wollen es ermöglichen, dass Anwender mit Drill direkte Abfragen in Spark durchführen können. Das erlaubt es, dass BI-Tools wie Microstrategy, Spotfire oder Tableau angebunden werden können, ohne weitere Werkzeuge verwenden zu müssen.

Mit verbesserter Zugriffskontrolle sollen Unternehmen den Anwendern im Unternehmen Schnittstellen zu Drill zur Verfügung stellen, die das Zugreifen auf die Daten in der Big-Data-Infrastruktur erleichtert. Das soll Entwickler und Administratoren entlasten. Dazu ist es aber notwendig, dass durch Sicherheitsmechanismen auch festgelegt werden kann, welche Benutzer und Gruppen auf die einzelnen Daten zugreifen dürfen. Erstellen Benutzer zum Beispiel einen virtuellen Datensatz (CREATE VIEW vd AS SELECT) um Informationen mit anderen Benutzern zu teilen, soll sich das besser steuern lassen. Der virtuelle Datensatz wird als SQL-Anweisung über Apache Drill definiert. Auf diesem Weg lassen sich zum Beispiel Daten auslesen, die nur in der letzten Woche gesammelt wurden, oder einige Spalten lassen sich für verschiedene Benutzer maskieren. Die SQL-Abfragen lassen sich als Dateien im Dateisystem speichern. Auf Basis der Zugriffe auf das Dateisystem kann jetzt gesteuert werden, wer die Abfrage nutzen darf.

Eine weitere Möglichkeit ist das Definieren einer virtuellen Datenmenge in der Datenquelle, auf die ein Benutzer Zugriff hat. Der Benutzer darf nur Abfragen für diese Daten erstellen und hat auf andere Daten keinen Zugriff. Dadurch entfallen weitere Berechtigungskonfigurationen, was Administratoren und Entwickler entlastet.

Fazit

Unternehmen, die sich mit Hadoop beschäftigen, kommen kaum um Spark und Drill herum. Auch wenn die beiden Technologien noch nicht im Einsatz sind, sollten sich Entwickler mit den Produkten auseinandersetzen. Da die Datenmengen in Big-Data-Infrastrukturen immer mehr anwachsen, ist die Verzahnung von Anwendungen, welche die Analyse großer Datenmengen beschleunigen, mehr als sinnvoll. Werden die Produkte bereits frühzeitig in das Big-Data-Projekt integriert, profitieren alle davon, das Unternehmen, die Anwender und die Entwickler.

(ID:43206559)

:quality(80)/p7i.vogel.de/wcms/e3/95/e39587300e125df30c7917372763139b/0130016264v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/87/b8/87b89fb6ef45cbd96a394a466cd67f23/0130816397v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/59/0b/590bdb8dd7816097e1c233b138c3cf92/0130720216v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/9b/ef/9bef0a77a5695439866debdaba18ba16/0130054146v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2f/b7/2fb7b07cbcbc23a80dcfbe41570c8cf2/0130493230v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a3/72/a3728398797ceec8ea2bca2b17fcd49d/0130470053v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8e/70/8e7083abba5bdaa5b5ab6972670ec5fd/0130190257v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/28/95/289560ddeb2ca55c1e003d57d331063c/0130126830v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/37/af/37af6545336ac8aac53cccaf675c22d5/0116632947v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/34/e734f4d362cad6fc347f5a049b1522db/0129238699v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/35/aa/35aa7935774f380a96e1e3de73c09661/0129631002v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/58/7a/587af12cf063f30f9f1dd8d09a8028ec/0129948269v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e1/53/e1539f6251b6e5502bd1856048c4267e/0128161589v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/d3/dc/d3dc300e714e34706f8e70ac540ebcdc/0130561240v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6f/2d/6f2d2fe91fa2a26ab63377f9ee7af674/0130803635v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b7/0a/b70a5c1423936cec92894bbc0e4b5420/0130683263v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/62/22/6222736cd26d88f18075cdd971cd1541/0129698372v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/80/31/80314a4d3263db61d8adec623a25c627/0130586130v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/a5/f4a5975b3a19ba3b86896a37c23dac7f/0130771937v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/75/da/75daff3c7113e9bfd5c842c2455e3ead/0130146226v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/3d/5b/3d5b7068884a97895ca65ad5ddbff0a8/0130031631v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/dd/f2/ddf24fdae5c827174f24449adf9aaf59/0130927746v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/11/d5/11d57961a97ae85fa56d451a8d29c4fb/0130890936v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/56/3c/563ce9a8669d69d214772cb907fce64d/0130929658v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/99/ba/99ba69a8921df4be68d3e4a900c863cb/0130092667v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d5/59/d5597bab8d5d2a99d6655c93a99ef357/0129935720v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/68/f8/68f8b9869e1288dfa2eeff3a1dc6a7eb/0127838110v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/74/05/74053661b14a2f12ec5e98ebd1469197/0127788138v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c9/1a/c91ad9dfc806cc7df9fe7074ca5e64dd/0127064676v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/43/e4/43e42f37cc71f12e6ae46717e700644e/0126701619v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/82/9a/829ab32db929fbae572a7c8290463a08/0121295821v1.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/67/c6/67c6df851ba69/qunis-profilbild.png)

:fill(fff,0)/p7i.vogel.de/companies/5e/b4/5eb41ddf8e0b6/bdi-insider-logo-2019.png)

:fill(fff,0)/p7i.vogel.de/companies/60/2c/602cdcaa1f5bc/fivetran-logo-blue.png)

:quality(80)/p7i.vogel.de/wcms/eb/bc/ebbcbb417d292f3d20cb3bf87706705c/0125514392v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/34/a2/34a2d02781eaabef906c308dd135c049/0130541481v1.jpeg)