Inspur AI Research Yuan 1.0 Sprachmodell mit 245,7 Milliarden Parametern vorgestellt

Das Inspur Artificial Intelligence Research Institute hat sein Sprachmodell Yuan 1.0 vorgestellt. Dabei handelt es sich laut Inspur um das größte Sprachmodell der Welt mit 245,7 Milliarden Parametern und fünf Terabyte an Datensätzen.

Anbieter zum Thema

Yuan 1.0 soll sich laut Inspur durch hohe Leistung sowohl beim Zero-Shot- als auch beim Little-Shot-Learning auszeichnen. Zudem kann das Modell Sprachinhalte generieren, die in vielen Fällen nicht von menschlich generierten Inhalten zu unterscheiden sind. Ein wissenschaftliches Paper auf arXiv beschreibt Entwicklung und Optimierung von Yuan 1.0 und entsprechende Testergebnisse.

Wie der Name schon vermuten lässt, handelt es sich bei Yuan 1.0 um ein chinesisches Sprachmodell. Dies erforderte im Vergleich zur englischen Sprache einen einzigartigen Entwicklungsprozess mit spezifischen Herausforderungen. Dazu zählen etwa die Bildung von Token in Sätzen ohne Leerzeichen oder das Fehlen eines qualitativ hochwertigen chinesischen Sprachkorpus als Grundlage. Die nötige Rechenleistung liefert ein dezentrales Lernsystem mit 2.128 GPUs.

Leistungsfähiges Modell

Auf dieser Basis gewann Yuan 1.0 sowohl in ZeroCLUE als auch in FewCLUE für den Chinese Language Understanding Benchmark (CLUE) den ersten Platz. In ZeroCLUE konnte Inspur den bisherigen Rekord um 18,3 Prozent übertreffen. Zudem wurde der erste Platz in sechs Aufgaben errungen: Klassifizierung von Themen aus der wissenschaftlichen Literatur sowie von Nachrichten, Produktklassifizierung, natürlichsprachliche Inferenz, Leseverständnis von Redewendungen und Substantiv-Pronomen-Beziehungen. In FewCLUE konnte Yuan 1.0 die Aufgaben Klassifizierung von Themen aus der wissenschaftlichen Literatur, Produktklassifizierung, Erkennung von Abstracts und Schlüsselwörtern aus der wissenschaftlichen Literatur und Substantiv-Pronomen-Beziehungen für sich entscheiden.

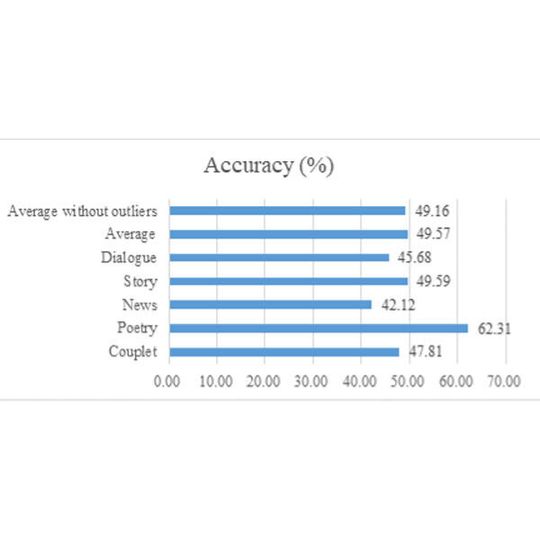

Laut Inspur übertraf das Sprachmodell vor allem beim Leseverständnis von Redewendungen menschliche Fähigkeiten. Zudem ist es besonders leistungsfähig bei der Generierung natürlicher Sprache („Natural Language Generating“, NLG). Es kann beispielsweise schriftliche Inhalte erzeugen, die den Turing-Test bestehen. Menschen konnte nur in weniger als der Hälfte aller Fälle von Yuan 1.0 erstellte Dialoge und Texte von nicht maschinell erzeugten Inhalten unterscheiden. Grundlage für diesen Erfolg sind zahlreiche Optimierungen von Modellarchitektur, Ergebniskalibrierung und Datensatzerstellung. So ermöglicht beispielsweise die Architektur die Berechnung von 245,7 Millionen Parametern mit einer Rechenleistung von 4.095 PetaFLOPS bei einem Lernverlust von 1,64.

(ID:47801032)

:quality(80)/p7i.vogel.de/wcms/e3/95/e39587300e125df30c7917372763139b/0130016264v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/87/b8/87b89fb6ef45cbd96a394a466cd67f23/0130816397v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/59/0b/590bdb8dd7816097e1c233b138c3cf92/0130720216v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/9b/ef/9bef0a77a5695439866debdaba18ba16/0130054146v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2f/b7/2fb7b07cbcbc23a80dcfbe41570c8cf2/0130493230v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a3/72/a3728398797ceec8ea2bca2b17fcd49d/0130470053v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8e/70/8e7083abba5bdaa5b5ab6972670ec5fd/0130190257v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/28/95/289560ddeb2ca55c1e003d57d331063c/0130126830v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/37/af/37af6545336ac8aac53cccaf675c22d5/0116632947v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/34/e734f4d362cad6fc347f5a049b1522db/0129238699v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/35/aa/35aa7935774f380a96e1e3de73c09661/0129631002v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/58/7a/587af12cf063f30f9f1dd8d09a8028ec/0129948269v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e1/53/e1539f6251b6e5502bd1856048c4267e/0128161589v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/62/22/6222736cd26d88f18075cdd971cd1541/0129698372v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/29/35/29353ee612bf3db5c99bb291a2942ad9/0130076540v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/9c/f0/9cf0a19c8b52fffcb843e8740b9b86dd/0130577594v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/5a/d6/5ad6f6f008e6b469ab5b2e2150f004f0/0130446509v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/75/da/75daff3c7113e9bfd5c842c2455e3ead/0130146226v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/3d/5b/3d5b7068884a97895ca65ad5ddbff0a8/0130031631v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/62/92/629205bfde96ccff154abc5010439584/0130634681v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d2/6c/d26cc237697e0910c49d2b8d45f4badf/0129929221v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/85/64/8564a8af5f8d3eddada95d651475d651/0130869867v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/60/5c/605c3c3c58560d2dc60e60044e48ebc6/0130712564v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/7b/58/7b583107fa356c33251960ebb1618ae4/0130140621v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/99/ba/99ba69a8921df4be68d3e4a900c863cb/0130092667v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d5/59/d5597bab8d5d2a99d6655c93a99ef357/0129935720v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/68/f8/68f8b9869e1288dfa2eeff3a1dc6a7eb/0127838110v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/74/05/74053661b14a2f12ec5e98ebd1469197/0127788138v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c9/1a/c91ad9dfc806cc7df9fe7074ca5e64dd/0127064676v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/43/e4/43e42f37cc71f12e6ae46717e700644e/0126701619v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/82/9a/829ab32db929fbae572a7c8290463a08/0121295821v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/72/fc/72fccae6fc9730693d469765c21b3829/0125757295v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/74/05/74053661b14a2f12ec5e98ebd1469197/0127788138v1.jpeg)