Grundlagen Statistik & Algorithmen, Teil 11 Methoden der Linearen Regressionsanalyse

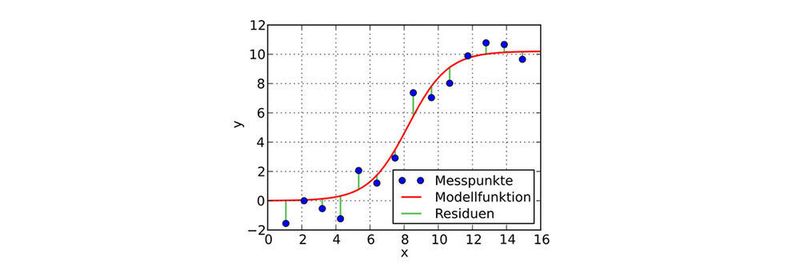

Regressionsanalysen dienen dazu, Prognosen zu erstellen und Abhängigkeiten in Beziehungen aufzudecken. Will ein Smartphone-Hersteller herausfinden, mit welchem Preis er in welchem Kundenkreis welchen Umsatz erzielen kann, so kennt er nur eine Variable – den Preis – aber nicht die anderen Variablen. Heute gibt es eine große Zahl solcher Verfahren, denn sie werden für zahlreiche Zwecke benötigt, etwa in der Epidemiologie.

Anbieter zum Thema

Bei Regressionsanalysen werden Beziehungen zwischen einer abhängigen und mehreren unabhängigen Variablen modelliert. Damit lassen sich Zusammenhänge quantitativ beschreiben oder Werte der abhängigen Variablen vorhersagen.

Eine weitere Anwendung besteht in der für jede moderne Kommunikation essenziellen Trennung zwischen Signal (Funktion) und Rauschen (Fehler) sowie der Abschätzung des dabei gemachten Fehlers, der Störfunktion. Weitere einführende Bemerkungen sind in dem Artikel von BigData-Insider über die Einfache Lineare Regression zu finden.

Multiple lineare Regression

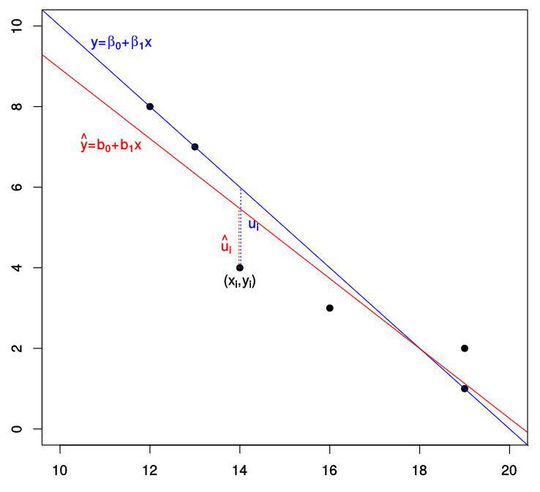

Die multiple lineare Regression wird auch „mehrfache lineare Regression“ (kurz: MLR) oder „lineare Mehrfachregression“ genannt. Sie ist ein regressionsanalytisches Verfahren und ein Spezialfall der linearen Regression. Die MLR versucht, eine beobachtete abhängige Variable durch mehrere unabhängige Variablen zu erklären. Das dazu verwendete Modell ist linear in den Parametern, wobei die abhängige Variable eine Funktion der unabhängigen Variablen ist. Diese Beziehung wird durch eine additive Störgröße überlagert. Die MLR stellt somit eine Verallgemeinerung der ELR bezüglich der Anzahl der Regressoren dar.

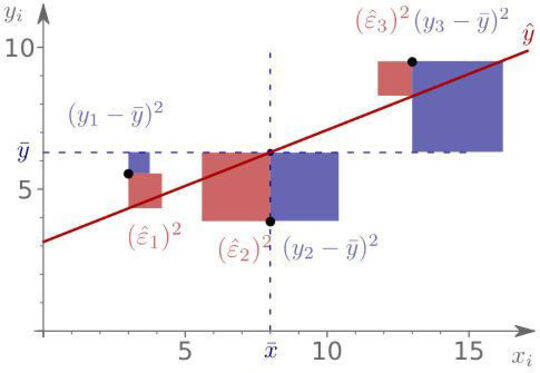

Bei der multiplen linearen Regression werden mehrere unabhängige Variablen oder Funktionen der unabhängigen Variablen berücksichtigt. Wird zum Beispiel der Term x hoch 2 zur vorigen Regression hinzugefügt, so ergibt sich: yi = β0 + β1xi + β2xi2 + eii = 1, ..., p. Dabei ist β der unbekannte Parameter. Obwohl der Ausdruck auf der rechten Seite quadratisch in der unabhängigen Variable ist, ist der Ausdruck linear in den Parametern β1, β2 und β3, und . Damit ist dies auch eine lineare Regressionsgleichung. Zur Bestimmung der Modellparameter wird die Methode der kleinsten Quadrate verwendet.

Die wesentliche Voraussetzung an das MLR besteht darin, dass es bis auf die Störgröße ε [Epsilon] das „wahre Modell“ beschreibt. Das zugrundeliegende „wahre Modell“ ist das eigentliche Populationsmodell, welches die Zielgröße und die relevanten Einflussgrößen in Beziehung zueinander setzt. Diese Beziehung wird durch eine additive Störgröße überlagert, für die angenommen wird, dass sie einen Erwartungswert von Null aufweist. Die grundlegende Annahme des Modells ist, dass es linear in den Parametern ist.

Im Modell wird in der Regel nicht genau spezifiziert, von welcher Art die Störgröße ε ist; sie kann beispielsweise von zusätzlichen Faktoren oder Messfehlern herrühren. Jedoch nimmt man als Grundvoraussetzung an, dass dessen Erwartungswert (in allen Komponenten) 0 ist (Annahme 1). Diese Annahme bedeutet, dass das Modell grundsätzlich für korrekt gehalten und die beobachtete Abweichung als zufällig angesehen wird oder von vernachlässigbaren äußeren Einflüssen herrührt.

Typisch ist die Annahme, dass die Komponenten des Vektors unkorreliert sind (Annahme 2) und dieselbe Varianz σ2 [kleines Sigma] besitzen (Annahme 3), wodurch sich mithilfe von Verfahren wie der Methode der kleinsten Quadrate (s.o.) einfache Schätzer für die unbekannten Parameter β und σ2 ergeben. Die Methode wird daher auch (multiple lineare) KQ-Regression bzw. KQ-Schätzer genannt. Es ist das Standardverfahren zur mathematischen Ausgleichsrechnung.

Der F-Test

Der globale F-Test, auch Globaltest, Gesamttest, Test auf Gesamtsignifikanz eines Modells, F-Test der Gesamtsignifikanz, Test auf den Gesamtzusammenhang eines Modells genannt, stellt eine globale Prüfung der Regressionsfunktion dar. Mit dem F-Test wird eine Kombination von linearen (Gleichungs-) Hypothesen geprüft und somit, ob mindestens eine Variable einen Erklärungsgehalt für das Modell liefert und das Modell somit als Gesamtes signifikant ist. Falls diese Hypothese verworfen wird, ist das Modell nutzlos. Diese Variante des F-Tests ist die gebräuchlichste Anwendung des F-Tests. Beim Spezialfall der Varianzanalyse kann man Unterschiede zwischen zwei Stichproben aufdecken.

:quality(80)/images.vogel.de/vogelonline/bdb/1430600/1430659/original.jpg)

Grundlagen Statistik & Algorithmen, Teil 4

Der Monte-Carlo-Algorithmus und -Simulationen

Der Test geht auf einen der bekanntesten Statistiker, Ronald Aylmer Fisher (1890 bis 1962) zurück. Er formulierte auch den verbreiteten T-Test.

Epidemiologie

In der Erfassung und Bekämpfung von Epidemien sind Stichproben von größter Bedeutung. Das Problem ist die Aufdeckung von Zusammenhängen und von Merkmalen, die signifikant sind. Die Stichproben dürfen daher nicht zu klein ausfallen.

Die Regressionsanalyse wurde schon früh genutzt, um den Zusammenhang zwischen Tabakrauchen und Krankheits- bzw. Sterblichkeitsrate von Rauchern zu erfassen und zu bewerten. Während in den 1920er-Jahren Werbekampagnen gewöhnliche Zigaretten den US-amerikanischen Frauen als „Fackeln der Freiheit“ anpriesen, dachte wohl keiner – zumindest nicht offiziell – dass Rauchen erhebliche Gesundheitsrisiken barg und birgt.

:quality(80)/images.vogel.de/vogelonline/bdb/1409900/1409917/original.jpg)

Grundlagen Statistik & Algorithmen, Teil 3

Speed für Mustererkennung mit dem Rete-Algorithmus

Doch Beobachtungsstudien, die Regressionsanalyse nutzten, entdeckten den o. g. Zusammenhang. Um zufällige Korrelationen bei der Analyse von Beobachtungsdaten auszuschließen, integrieren Forscher üblicherweise verschiedene Variablen in ihre Regressionsmodelle, zusätzlich zu ihrer primären unabhängigen Variable: das Rauchen etwa. Die abhängige Variable ist Lebensdauer (in Jahren), aber zusätzlich integrieren die Forscher Variablen wie Ausbildungsniveau und Einkommensklasse, also sozioökonomische (und ernährungsmäßige) Faktoren. Diese Störfaktoren wollen sie ausschließen, um so den primären Faktor, das Rauchen, zu determinieren.

:quality(80)/images.vogel.de/vogelonline/bdb/1481900/1481934/original.jpg)

Grundlagen Statistik & Algorithmen, Teil 5

Optimale Clusteranalyse und Segmentierung mit dem k-Means-Algorithmus

Sämtliche Störfaktoren auszuschließen, ist in einer empirischen Untersuchung kaum jemals möglich. Beispielsweise könnte ein hypothetisches Gen die Sterblichkeitsrate beeinflussen oder Leute dazu bringen, mehr zu rauchen. Um solche Störfaktoren aufzuspüren und zu eliminieren, werden häufig zufallsbasierte, kontrollierte Versuchsreihen ausgeführt. Falls es kausale Zusammenhänge gibt, fördern diese Stichproben eher Beweise zutage als Regressionsanalysen von Beobachtungsdaten. Lassen sich jedoch kontrollierte Versuche nicht realisieren, kann man Varianten der MLR wie etwa Instrumentvariablenschätzung nutzen, um kausale Zusammenhänge in Beobachtungsdaten aufzuspüren.

(ID:46549839)

:quality(80)/p7i.vogel.de/wcms/e3/95/e39587300e125df30c7917372763139b/0130016264v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/87/b8/87b89fb6ef45cbd96a394a466cd67f23/0130816397v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/59/0b/590bdb8dd7816097e1c233b138c3cf92/0130720216v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/9b/ef/9bef0a77a5695439866debdaba18ba16/0130054146v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2f/b7/2fb7b07cbcbc23a80dcfbe41570c8cf2/0130493230v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a3/72/a3728398797ceec8ea2bca2b17fcd49d/0130470053v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8e/70/8e7083abba5bdaa5b5ab6972670ec5fd/0130190257v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/28/95/289560ddeb2ca55c1e003d57d331063c/0130126830v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/37/af/37af6545336ac8aac53cccaf675c22d5/0116632947v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/34/e734f4d362cad6fc347f5a049b1522db/0129238699v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/35/aa/35aa7935774f380a96e1e3de73c09661/0129631002v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/58/7a/587af12cf063f30f9f1dd8d09a8028ec/0129948269v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e1/53/e1539f6251b6e5502bd1856048c4267e/0128161589v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/d3/dc/d3dc300e714e34706f8e70ac540ebcdc/0130561240v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6f/2d/6f2d2fe91fa2a26ab63377f9ee7af674/0130803635v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b7/0a/b70a5c1423936cec92894bbc0e4b5420/0130683263v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/62/22/6222736cd26d88f18075cdd971cd1541/0129698372v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/80/31/80314a4d3263db61d8adec623a25c627/0130586130v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/a5/f4a5975b3a19ba3b86896a37c23dac7f/0130771937v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/75/da/75daff3c7113e9bfd5c842c2455e3ead/0130146226v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/3d/5b/3d5b7068884a97895ca65ad5ddbff0a8/0130031631v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d7/0d/d70dce67c79b25c56fce32f55fde250d/0131049515v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/71/a1/71a174024e45e003ca8d03f5e2322672/0130533946v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/99/ba/99ba69a8921df4be68d3e4a900c863cb/0130092667v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d5/59/d5597bab8d5d2a99d6655c93a99ef357/0129935720v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/68/f8/68f8b9869e1288dfa2eeff3a1dc6a7eb/0127838110v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/74/05/74053661b14a2f12ec5e98ebd1469197/0127788138v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c9/1a/c91ad9dfc806cc7df9fe7074ca5e64dd/0127064676v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/43/e4/43e42f37cc71f12e6ae46717e700644e/0126701619v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/82/9a/829ab32db929fbae572a7c8290463a08/0121295821v1.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/68/2d/682dd583dcc4c/fsas-afc-horizontal-2-positive-rgb-nov24.png)

:fill(fff,0)/p7i.vogel.de/companies/67/c6/67c6df851ba69/qunis-profilbild.png)

:quality(80)/p7i.vogel.de/wcms/d4/90/d49096fad857f07b788198c34b35e010/0128339234v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/57/f5/57f51fb2030e615747fcfba43835725d/0128237968v1.jpeg)