Daten in Bewegung “Big Data as a Service” gehört die Zukunft - nur wie sieht die aus?

Um in der heutigen Welt konkurrieren und gewinnen zu können, gilt es alles jederzeit zu optimieren. Dazu gehören auch Software-Architekturen, die immer mehr Kernprozesse und -aspekte des Business tragen. Denn die Kundenerwartungen wurden und werden von „Digital Natives” gesetzt – Unternehmen, die von Grund auf auf modernen Plattformen aufbauen. Skalierung? Kein Problem!

Gesponsert von

Die Erwartungshaltung an digitale Kundenerlebnisse und vollständig integrierte Echtzeitabläufe passt nicht mit Daten- und Infrastruktur-Silos zusammen. Daten müssen über das komplette Unternehmen hinweg kontinuierlich gesammelt, verarbeitet und in Applikationen reaktiv genutzt werden.

Für Unternehmen geht es dabei nicht nur um Automatisierung, sondern um eine ganzheitliche Neuausrichtung des Geschäfts. Das bedeutet: Während im Frontend nachhaltige digitale Kundenerlebnisse geschaffen werden, muss das Backend hochentwickelte, software-gesteuerte Abläufe in Echtzeit umsetzen können.

Endlich Echtzeit?

Wir können uns also darauf einigen, dass Kundenerfahrungen am Frontend und die Backend-Abläufe eines Unternehmens Aktivitäten sind, die permanent und in Echtzeit stattfinden. Das aktuelle Paradigma für die Dateninfrastruktur unterstützt jedoch keinen kontinuierlichen Echtzeit-Datenfluss. Das Geschäft ist Echtzeit – unsere Daten sind es nicht.

Ein gutes Beispiel hierfür ist das Telefonat mit der Taxizentrale versus der Live-Verfolgung des Taxis per App. Wir erwarten den genauen Standort des Taxis und eine Änderung der Ankunftszeit aufgrund einer roten Ampel in Echtzeit sehen zu können.

Im Zentrum der heutigen Datenverwaltung stehen nach wie vor Datenbanken. Aus dem Erbe der Datenspeicherung hervorgegangen, wurden sie entwickelt, um einer isolierten, UI-zentrierten Anwendung den Zugriff auf gespeicherte Daten als Reaktion auf menschliche Interaktion zu ermöglichen. Sie sind, kurz gesagt, eine Plattform, die für ruhende Daten entwickelt wurde.

Datenbanken bleiben eine wichtige Kategorie, reichen aber als alleinige Datenplattform in einem Unternehmen nicht mehr aus.

Moderne Datenplattformen sowie die Systeme, die den Geschäftsbetrieb ausführen und Kundenerlebnisse liefern, müssen integriert sein und Daten in Echtzeit verarbeiten können. Sie müssen die Infrastruktursilos überwinden und kontinuierlich auf ein sich ständig weiterentwickelndes Geschäft reagieren, antworten und sich anpassen, sobald eine Änderung oder eine Interaktion eintritt. Unternehmen benötigen somit eine Dateninfrastruktur, die das Sammeln eines kontinuierlichen Datenstroms aus dem gesamten Unternehmen unterstützt und Anwendungen erstellt, die diesen Datenstrom in Echtzeit verarbeiten.

Dies ist ein grundlegender Paradigmenwechsel und trifft den Kern dessen, wie wir über Daten denken. “Data in Motion” ist nicht nur eine fehlende Funktion in Datenbanken, sondern ein grundlegendes Umdenken in der Informatik, die Datensystemen zugrunde liegt.

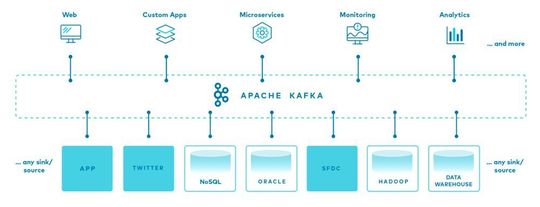

Apache Kafka® als skalierbares Fundament für “Data in Motion”

Als Standard für die Handhabung von “Data in Motion” hat sich in den letzten Jahren Apache Kafka etabliert. Über 80% der Fortune 100 setzen auf die Event-Streaming-Plattform, die bei LinkedIn erfunden wurde und seitdem einen Siegeszug durch die Architekturen von eingesessenen Unternehmen und Digital Natives macht.

Einer der Hauptgründe, warum Apache Kafka zum De-facto-Standard für so viele verschiedene Anwendungsfälle wurde, ist die Kombination aus vier leistungsstarken Konzepten:

- Publish & Subscribe auf Event-Streams, ähnlich wie bei einem auf Message Queues basierenden Enterprise-Messaging-System

- Speichern von Event-Streams in einem fehlertoleranten und persistenten Speicher, solange die Daten benötigt werden (Stunden, Tage, Monate, dauerhaft)

- Kontinuierliches Verarbeiten, Korrelieren und Aggregieren von Ereignisströmen in Echtzeit

- Integration von verschiedenen Daten-Quellen und -Senken (egal ob die Schnittstelle Echtzeit, Batch oder Request-Response Kommunikationsparadigmen anbietet)

Kafka in der Cloud?

Der Aufstieg von “Data in Motion” ist ein weltweites Phänomen, das sich auf jede Branche, jede Region und jede Art von Unternehmen auswirkt. Es war nur eine Frage der Zeit, bis auch dieses Paradigma den Weg in die Cloud findet. In vielen der größten Tech-Giganten verarbeiten deren Data-in-Motion-Plattformen jeden Tag Petabytes an Daten, die permanent in Bewegung sind. Dabei wird jeder Teil eines riesigen digitalen Unternehmens verbunden und alle Aktivitäten des Unternehmens werden über Streams erfasst und verarbeitet.

Dieses Paradigma hat sich jedoch weit über die reinen Tech-Unternehmen hinaus verbreitet und wird mittlerweile von über 80 % der Fortune-100-Unternehmen eingesetzt.

Ein paar Beispiele:

Use Cases in Branchen

- Einzelhändler nutzen "Data in Motion", um ihre stationären Geschäfte mit E-Commerce-Systemen in Echtzeit zu vereinen und so ein einheitliches Kundenerlebnis zu schaffen. Mit Echtzeit-Bestandsmanagement können Einzelhändler sicherstellen, dass Kunden nie einen Artikel online kaufen, nur um später festzustellen, dass er nicht mehr vorrätig ist, wenn sie ihn abholen wollen.

- Ride-Sharing-Unternehmen schaffen ein mobiles Echtzeit-Erlebnis mit sofortigem Fahrer-Fahrgast-Matching, dynamischer Preisgestaltung und in Echtzeit aktualisierter Fahrer-Ankunftszeit.

- Banken nutzen “Data in Motion”, um Kreditkartenbetrug zu erkennen und zu verhindern: Statt Überprüfung der Transaktionen über Nacht werden Echtzeit-Warnungen über Smartphones ausgespielt.

- Telefonanbieter können von periodischen Inspektionen zu einer vorausschauenden Überwachung in Echtzeit übergehen.

Technische Use Cases & Unterstützung von Technologietrends

- Unterstützung der Cloud-Einführung, indem eine Data-in-Motion-Plattform als Echtzeit-Synchronisation zwischen älteren Teilen eines Unternehmens, die in On-Prem-Rechenzentren betrieben werden, und modernen Cloud-Umgebungen fungiert.

- Erschließung von Datenquellen im ganzen Unternehmen, um Machine-Learning-Anwendungen zu speisen und komplexe Trainings- und Produktionsabläufe zu realisieren.

- Backbone für Echtzeit-Datenströme, die von Sensoren, mobilen Geräten, aus der Fertigung und aus Fahrzeugen stammen.

Warum werden nun immer mehr dieser Use Cases im Rahmen des cloud-nativen und voll gemanagten Kafka-Services von Confluent umgesetzt?

Der Wert von Apache Kafka und Echtzeitdaten für Unternehmen steht außer Frage. Leider sind die Kosten der Selbstverwaltung sehr oft zu kostspielig, wenn man Faktoren wie Skalierung, Verwaltung, Support, Sicherung oder die Erstellung von Konnektoren addiert. Ressourcen in Unternehmen sind knapp: Dies betrifft sowohl die besten Teammitglieder als auch das Budget. Diese Ressourcen sollen nicht durch die tägliche Verwaltung von Kafka gebunden sein, sondern Projekten, die einen Wettbewerbsvorteil liefern oder eine Geschäftsdifferenzierung schaffen, vollumfänglich zur Verfügung stehen.

Viele Unternehmen stellen daher auf einen vollständig gemanagten cloud-nativen Kafka-Service um.

Was sollte er also können, der cloud-native Daten-Streaming-Service?

Elastische Skalierbarkeit

Kafka-Cluster können je nach Bedarf serverlos, auto-balanced bereitgestellt werden und elastisch zwischen 0-100 MBps skalieren oder sich mit wenigen Klicks auf GBps+ skalieren lassen. Diese sofortige Elastizität bedeutet, dass in alle Richtungen skaliert werden kann, um entweder einen unerwarteten Bedarf zu decken oder um die Kosten unter Kontrolle zu behalten. Bezahlt wird für das, was benötigt wird, und zwar dann, wann es benötigt wird – nicht mehr und nicht weniger.

Zugriff, aber bitte global

Studien haben gezeigt, dass 80 Prozent der Unternehmen mehr als einen Cloud Service Provider nutzen. Wenn die Kafka-Implementierung nur auf einem von diesen funktioniert, beschränkt das natürlich die Handlungsfähigkeit – vor allem im Bereich der Datennutzung. Confluent erlaubt eine Verknüpfung der Kafka-Cluster, die sich in Echtzeit synchronisieren, sodass Events überall verfügbar sind – über mehrere Public oder Private Clouds hinweg.

Unbegrenzter Speicher

Datenmengen können unbegrenzt in Kafka-Clustern gespeichert werden, ohne dass im Voraus Kapazitäten geplant oder bereitgestellt werden müssen. Kafka wird zu einem “System of Record”, so dass aus Echtzeit-Events alles herausgeholt werden kann. Weiterer positiver Nebeneffekt: Es müssen keine Ressourcen abgezogen werden, um Ausfallzeiten aufgrund von Ausfällen des Festplattenspeichers abzufangen.

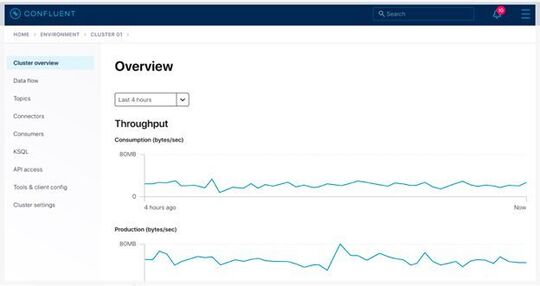

Eine komplette Event-Streaming-Plattform

Confluent macht mehr als nur Kafka zu verwalten. Unternehmen erhalten eine komplette Plattform, die auf Kafka aufbaut, damit Projekte schnell umgesetzt werden können. Dies beinhaltet sofort einsatzbereite Konnektoren für die beliebtesten Datenquellen und -senken im Kafka-Ökosystem, eine Schema Registry zur Gewährleistung der Datenintegrität, eine Event-Streaming-Datenbank mit ksqlDB und vieles mehr – alles vollständig verwaltet in ein und derselben Cloud-UI (Abb. 3).

Unternehmen sind immer in Bewegung – ein zentrales Nervensystem kann mithalten

“Data in Motion” steht für die Hälfte des Datenmanagement-Problems, die bisher weitgehend ignoriert worden ist.

Aber: Dieses Paradigma hat das Potenzial, unser Denken und unsere Nutzung von Daten in ähnlichem Maße zu verändern, wie die Cloud unser Denken und unsere Nutzung von Hardware-Infrastrukturen verändert hat. Man nimmt etwas, das statisch war, und verwandelt es in etwas, das dynamisch und allgegenwärtig ist.

Diese Fähigkeit zu nutzen und eine zentrale Integrationsschicht aufzubauen, welche die Systeme und Anwendungen des Unternehmens zu einem kohärenten Ganzen zusammenfügt, wird für die nächste Generation von Unternehmen entscheidend sein. Die Data-in-Motion-Plattform übernimmt die Rolle eines zentralen Nervensystems für Daten und trägt den Strom der Impulse dessen, was geschieht, durch alle Teile des Unternehmens. So kann überall auf diese Echtzeitströme reagiert, geantwortet oder diese verarbeitet werden. Verschiedenen Anwendungen und Software-Services werden so koordiniert, dass sie kontinuierlich und intelligent reagieren, wenn sich das Unternehmen weiterentwickelt.

Die Fähigkeit, Daten in Bewegung zu denken und nutzen zu können, ist kein entscheidender Wettbewerbsvorteil der Zukunft, sondern der Gegenwart. Die cloud-native Umsetzung dieses Paradigmas versetzt Unternehmen direkt in die Lage, diese Gegenwart zeitgemäß zu gestalten.

Unternehmen wie BOSCH, Ricardo, Baader, NORD/LB, Deutsche Bahn oder BMW setzen bereits erfolgreich auf “Data in Motion” und schaffen Mehrwert in Echtzeit.

Confluent Cloud kann kostenlos getestet werden: https://www.confluent.de/confluent-cloud/

(ID:47560670)

:quality(80)/p7i.vogel.de/wcms/dd/de/ddded0c562bc86a964c72636ce14c0be/0130192405v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e3/95/e39587300e125df30c7917372763139b/0130016264v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/87/b8/87b89fb6ef45cbd96a394a466cd67f23/0130816397v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/59/0b/590bdb8dd7816097e1c233b138c3cf92/0130720216v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2f/b7/2fb7b07cbcbc23a80dcfbe41570c8cf2/0130493230v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a3/72/a3728398797ceec8ea2bca2b17fcd49d/0130470053v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8e/70/8e7083abba5bdaa5b5ab6972670ec5fd/0130190257v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/28/95/289560ddeb2ca55c1e003d57d331063c/0130126830v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/37/af/37af6545336ac8aac53cccaf675c22d5/0116632947v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/34/e734f4d362cad6fc347f5a049b1522db/0129238699v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/35/aa/35aa7935774f380a96e1e3de73c09661/0129631002v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/58/7a/587af12cf063f30f9f1dd8d09a8028ec/0129948269v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e1/53/e1539f6251b6e5502bd1856048c4267e/0128161589v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/d3/dc/d3dc300e714e34706f8e70ac540ebcdc/0130561240v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6f/2d/6f2d2fe91fa2a26ab63377f9ee7af674/0130803635v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b7/0a/b70a5c1423936cec92894bbc0e4b5420/0130683263v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/62/22/6222736cd26d88f18075cdd971cd1541/0129698372v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/80/31/80314a4d3263db61d8adec623a25c627/0130586130v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/a5/f4a5975b3a19ba3b86896a37c23dac7f/0130771937v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/75/da/75daff3c7113e9bfd5c842c2455e3ead/0130146226v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/3d/5b/3d5b7068884a97895ca65ad5ddbff0a8/0130031631v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/94/83/9483bf84226ce367728d4ab11893f6eb/0130989382v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/41/4e/414e0f6271145eb852d7ed82596e3fab/0130935096v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c6/de/c6de64af2c6001131a4677f157a8fac5/0130960706v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/99/ba/99ba69a8921df4be68d3e4a900c863cb/0130092667v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d5/59/d5597bab8d5d2a99d6655c93a99ef357/0129935720v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/68/f8/68f8b9869e1288dfa2eeff3a1dc6a7eb/0127838110v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/74/05/74053661b14a2f12ec5e98ebd1469197/0127788138v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c9/1a/c91ad9dfc806cc7df9fe7074ca5e64dd/0127064676v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/43/e4/43e42f37cc71f12e6ae46717e700644e/0126701619v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/82/9a/829ab32db929fbae572a7c8290463a08/0121295821v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/9b/b7/9bb7262b2aa0544674d00838d4571111/0129985592v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ba/e7/bae771a7dbd49331972bf09d368b97a0/0124900272v1.jpeg)